Unbedachte ChatGPT-Eingaben in Pflegeheimen gefährden Bewohnerdaten, führen zu DSGVO-Risiken und schädigen Vertrauen.

Pflegeheime riskieren massive Datenschutzverstöße, wenn Mitarbeitende KI-Tools wie ChatGPT für die Dokumentation nutzen. Sensible Bewohnerdaten, die unbedacht eingegeben werden, können auf Servern außerhalb der EU landen. Das verstößt gegen die DSGVO und kann Bußgelder von bis zu 20 Millionen Euro oder 4 % des Jahresumsatzes nach sich ziehen.

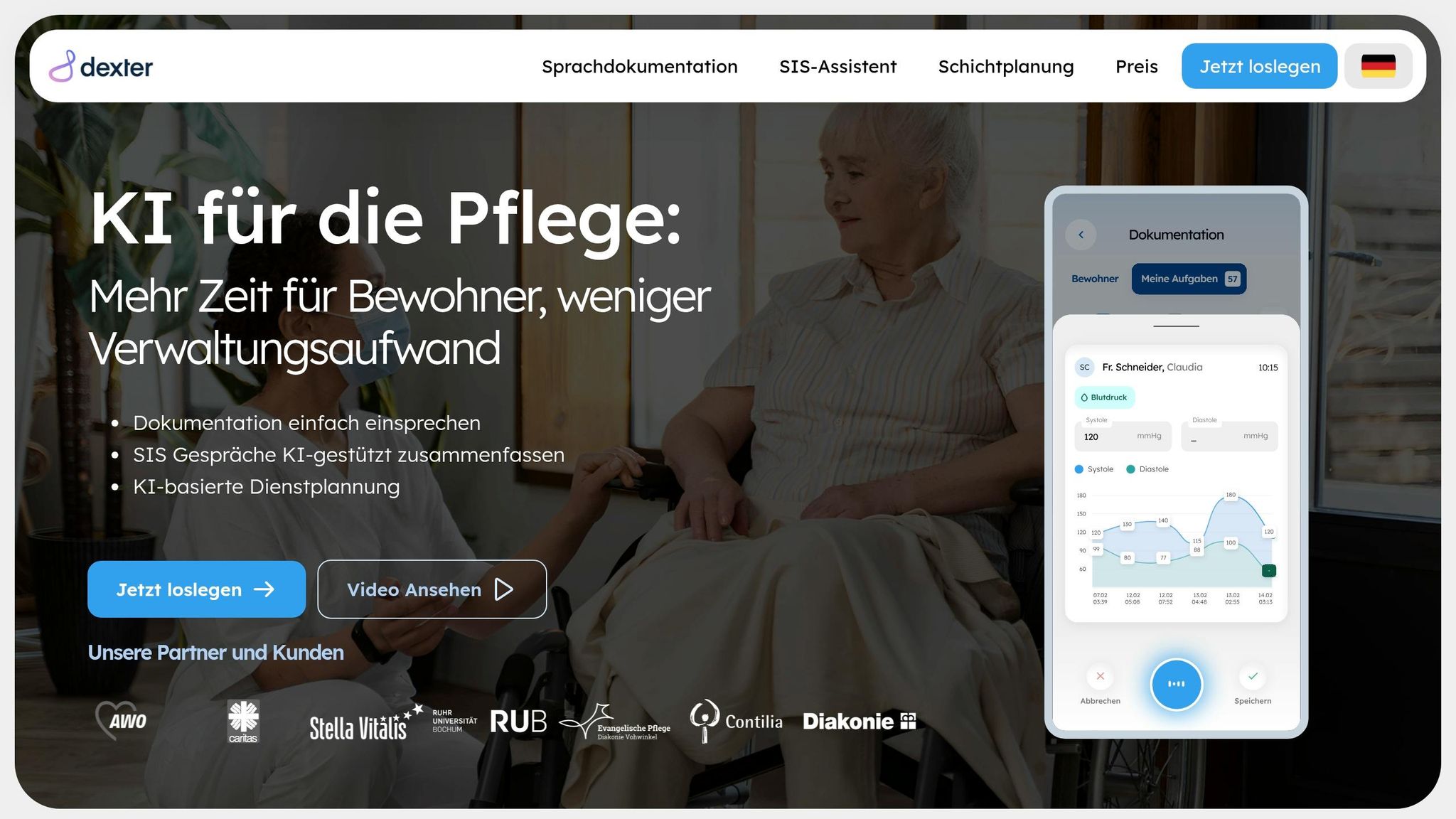

DSGVO-konforme Tools wie dexter health bieten sichere Alternativen. Diese speichern Daten ausschließlich auf EU-Servern, verschlüsseln Informationen und verhindern externe Zugriffe. Eine klare Organisation und Schulung des Personals sind dabei entscheidend.

Pflegekräfte geben unbewusst sensible Bewohnerdaten in ChatGPT ein, um Pflegeberichte zu erstellen, wodurch personenbezogene Informationen extern gespeichert werden. Dabei landen Details wie Namen, Alter, Diagnosen und Pflegesituationen in der Eingabemaske [3]. Ein Vorfall im März 2026 zeigt die Gefahr: Eine Pflegekraft nutzte ihr privates Smartphone, um mithilfe von ChatGPT einen Pflegebericht zu erstellen. Durch die Kombination aus Alter, spezifischer Erkrankung und aktueller Situation wurde die Bewohnerin auf externen Servern identifizierbar [3].

Selbst ohne direkte Nennung des Namens können Angaben wie Alter und Krankheitsbild Rückschlüsse auf die Person ermöglichen. Lars Werner, Datenschutzbeauftragter für Pflegeeinrichtungen, betont:

„Das Problem ist, dass Kombinationen aus Alter, Krankheitsbild und Situation oft einer bestimmten Person zugeordnet werden können" [3].

Diese Risiken werden durch ein unzureichendes Verständnis der Funktionsweise von KI-Tools noch verstärkt.

Viele Mitarbeitende wissen nicht, dass öffentliche KI-Tools Eingaben speichern und verarbeiten. Sie glauben, dass das Weglassen des Namens oder die Nutzung eines privaten Smartphones keine gravierenden Konsequenzen hat [3]. Lars Werner stellt daher eine entscheidende Frage:

„Die entscheidende Frage ist nicht, ob solche Nutzungen stattfinden. Sondern ob sie von der Einrichtung überhaupt überwacht und gesteuert werden" [3].

Die Verantwortung für den Datenschutz liegt jedoch immer bei der Heimleitung, unabhängig vom genutzten Gerät. Verstöße können nicht nur rechtliche Konsequenzen haben, sondern auch das Vertrauen der Bewohner nachhaltig schädigen.

Pflegekräfte stehen unter enormem Zeitdruck, da ihre Schichten eng getaktet sind und Dokumentationen oft zwischen Bewohnerbesuchen erfolgen müssen. Um Zeit zu sparen, greifen sie auf schnelle, aber riskante Lösungen zurück: ChatGPT erstellt in Sekunden Texte, sei es für Pflegeberichte mit Spracherkennung, E-Mails an Angehörige oder interne Mitteilungen [3]. Lars Werner beschreibt das grundlegende Problem:

„Die größten Risiken entstehen nicht durch einzelne Fehlentscheidungen, sondern durch strukturelle Lücken" [3].

Diese strukturellen Defizite verdeutlichen, wie dringend Pflegeeinrichtungen DSGVO-konforme Prozesse etablieren müssen.

Verstöße gegen Datenschutzvorgaben können für Pflegeheime schwerwiegende finanzielle Folgen haben. Die DSGVO sieht Bußgelder von bis zu 20.000.000 € oder 4 % des weltweiten Jahresumsatzes des vorangegangenen Geschäftsjahres vor – je nachdem, welcher Betrag höher ist[5]. Diese Regelungen sind keineswegs theoretisch: Im März 2023 verhängte die italienische Datenschutzbehörde ein sofortiges Nutzungsverbot für ChatGPT und drohte OpenAI mit einem Bußgeld. Der Grund? Fehlende Rechtsgrundlage für die Datenerhebung und ein Datenleck, das sensible Informationen wie Nutzerkonversationen und Zahlungsdaten offenlegte[5].

Für ein Pflegeheim mit 100 Bewohnern und einem Jahresumsatz von 5.000.000 € könnte dies eine Strafe von bis zu 200.000 € bedeuten[5]. Die IT-Recht Kanzlei warnt eindringlich:

„Wenn Unternehmen selbst nicht genau wissen, was das von ihnen genutzte Tool (ChatGPT) eigentlich mit personenbezogenen Daten macht, können sie ihre DSGVO-Transparenzpflichten nicht erfüllen."[5]

Zusätzlich zu den finanziellen Risiken können Datenpannen auch die behördliche Überprüfung erschweren.

Ein schlechtes Datenmanagement kann sich direkt auf die Ergebnisse von Audits durch den Medizinischen Dienst auswirken und den organisatorischen Aufwand erheblich erhöhen[3]. Landesdatenschutzbehörden in Deutschland haben zudem die Befugnis, den Einsatz von KI-Tools wie ChatGPT zu untersagen, wenn diese die DSGVO-Vorgaben nicht einhalten. Ohne eine gültige Auftragsverarbeitungsvereinbarung (AVV) verstoßen Einrichtungen gegen Art. 28 DSGVO, da sie nicht sicherstellen können, dass personenbezogene Daten ausschließlich gemäß ihren Anweisungen verarbeitet werden[5].

Ab August 2026 treten die Sanktionsregeln des EU AI Act vollständig in Kraft. Dieser betrifft insbesondere „Hochrisiko"-KI-Systeme, zu denen auch Anwendungen im Gesundheitswesen zählen. Pflegeeinrichtungen müssen sich auf strengere Transparenz- und Risikomanagementpflichten einstellen[4].

Neben den administrativen Sanktionen können schwerwiegende Verstöße auch strafrechtliche Konsequenzen nach sich ziehen.

Gravierende Datenschutzverstöße können zur persönlichen Haftung der Heimleitung führen, insbesondere wenn organisatorische Mängel nachweisbar sind[3]. Lars Werner, ein externer Datenschutzbeauftragter für Pflegeeinrichtungen, betont:

„Die Verantwortung bleibt bei der Einrichtung. Bußgelder sind möglich, aber es beginnt oft mit Unsicherheit und fehlender Struktur."[3]

Darüber hinaus können Datenschutzbehörden bei Verstößen sofortige Nutzungsverbote für bestimmte KI-Tools aussprechen[5]. Ein aktuelles Beispiel zeigt, wie konsequent solche Regelungen durchgesetzt werden: Im März 2024 verhängte Frankreich eine Strafe von 250.000.000 € gegen Google, da dessen KI-Anwendung „Gemini" Inhalte von Medienunternehmen ohne rechtliche Grundlage nutzte[4].

Wenn sensible Bewohnerdaten in öffentliche KI-Tools gelangen, verlieren Einrichtungen die Kontrolle darüber, wo und wie diese Informationen gespeichert werden. Besonders kritisch: Gesundheitsdaten werden oft auf Servern außerhalb der EU verarbeitet, was die Datensouveränität gefährdet. In den USA beispielsweise sind Anbieter wie OpenAI gesetzlich verpflichtet, ChatGPT-Konversationen dauerhaft zu speichern. Das bedeutet, dass einmal eingegebene Informationen im System verbleiben können [7]. Die Folgen sind real: Identitätsdiebstahl und der Missbrauch persönlicher Daten sind nur zwei der potenziellen Risiken [3]. Diese Gefahren beeinträchtigen nicht nur den Schutz der Bewohner, sondern haben auch direkte Auswirkungen auf den Ruf der betroffenen Einrichtung.

Datenpannen führen oft zu einem Vertrauensverlust bei Angehörigen, die die Fähigkeit der Einrichtung, mit sensiblen Informationen umzugehen, in Frage stellen [3]. Lars Werner, ein externer Datenschutzbeauftragter für Pflegeeinrichtungen, fasst die Herausforderung treffend zusammen:

„Ziel ist es, Datenschutz nicht als Hürde, sondern als Qualitätsmerkmal und Teil professioneller Pflegekultur zu etablieren." [3]

Einrichtungen, die diesen Anspruch nicht erfüllen, riskieren, als unprofessionell wahrgenommen zu werden. Datenschutz ist mittlerweile ein zentraler Bestandteil der Pflegequalität. Verstöße schädigen nicht nur das Vertrauen der Öffentlichkeit, sondern führen auch zu intensiveren Kontrollen durch Aufsichtsbehörden und den Medizinischen Dienst [3]. Um solche Folgen zu vermeiden, ist ein konsequentes Datenschutzmanagement unerlässlich.

Datenpannen belasten nicht nur Bewohner und Einrichtungen, sondern auch das Personal. Die Bewältigung solcher Vorfälle erfordert oft einen enormen organisatorischen Aufwand und setzt Mitarbeitende unter erheblichen Druck. Prüfungen durch Aufsichtsbehörden und besorgte Anfragen von Angehörigen verstärken den Stress zusätzlich [3]. Lars Werner bringt das Kernproblem auf den Punkt:

„Das eigentliche Problem ist nicht die Technologie. Das Problem ist die Organisation." [3]

Wenn Datenschutz nur sporadisch statt systematisch umgesetzt wird, leidet die Pflegequalität spürbar [3]. Ein klar strukturierter Umgang mit Datenschutz ist daher nicht nur für die Bewohner, sondern auch für die Mitarbeitenden essenziell.

DSGVO-konforme KI-Tools vs. öffentliche KI-Tools im Pflegheim-Vergleich

DSGVO-konforme KI-Lösungen für Pflegeheime setzen auf Server innerhalb der EU, um die Einhaltung der Artikel 44 bis 50 der DSGVO sicherzustellen. Server außerhalb der EU, wie etwa in den USA, unterliegen hingegen Gesetzen wie dem CLOUD Act, die ausländischen Behörden potenziell Zugriff auf Daten gewähren können. Zusätzlich wird durch Ende-zu-Ende-Verschlüsselung, zum Beispiel nach dem AES-256-Standard, gewährleistet, dass Daten sowohl während der Übertragung als auch bei der Speicherung unlesbar bleiben.

Weitere wichtige Sicherheitsmaßnahmen umfassen rollenbasierte Zugriffskontrollen, die sicherstellen, dass nur autorisiertes Personal auf sensible Informationen zugreifen kann. Audit-Protokolle dokumentieren zudem jeden Zugriff. Die Tools müssen außerdem die Anforderungen des § 630f BGB für digitale Dokumentation erfüllen und SIS-konforme Ausgaben erstellen können, ohne dabei Rohdaten zu exportieren. Regelmäßige Sicherheitsaudits und Zertifizierungen wie ISO 27001 bestätigen den hohen Sicherheitsstandard dieser Systeme. Ein Beispiel hierfür ist dexter health, das zeigt, wie Bewohnerdaten zuverlässig geschützt werden können.

dexter health ist eine in Deutschland entwickelte KI-Lösung, die speziell für Pflegeeinrichtungen entwickelt wurde. Mit der integrierten sprachgesteuerte Pflegedokumentation können Pflegekräfte Notizen direkt per Spracheingabe erfassen. Die Verarbeitung erfolgt entweder lokal oder über sichere Server innerhalb der EU – öffentliche Tools wie ChatGPT werden dabei nicht genutzt. Alle Daten werden Ende-zu-Ende verschlüsselt, und die Software ist sowohl DSGVO-zertifiziert als auch ISO 27001-konform.

Ein Pilotprojekt in einem bayerischen Pflegeheim zeigte, dass dexter health die Dokumentationszeit um 40 % reduzieren konnte, während gleichzeitig 100 % potenzieller externer KI-Zugriffe blockiert wurden. Innerhalb eines Zeitraums von zwölf Monaten trat kein einziges Datenleck auf – ein deutlicher Unterschied zu einem Fall in Berlin im Jahr 2023, bei dem ein Pflegeheim durch die Nutzung von ChatGPT Daten verlor und mit einem Bußgeld von 50.000 € belegt wurde [8].

Zusätzlich bietet dexter health On-Premise-Deployment-Optionen und garantiert die Meldung von Datenpannen innerhalb von 72 Stunden gemäß Artikel 33 der DSGVO. Die Software lässt sich nahtlos über HL7 FHIR oder REST-APIs in bestehende Pflegesoftware wie CGM M1 oder TietoEvry integrieren, wodurch manuelle Eingaben entfallen und das Risiko unsicherer Kopiervorgänge minimiert wird.

Auf Grundlage der beschriebenen Sicherheitsanforderungen zeigen wir, wie Sie dexter health problemlos in Ihre Einrichtung integrieren können.

Die Integration von dexter health erfolgt über HL7 FHIR- oder REST-APIs, die eine unkomplizierte Verbindung zu Ihrer bestehenden Pflegedokumentationsinfrastruktur ermöglichen. Wichtig: Die über APIs übertragenen Daten werden nicht für das Training externer Modelle verwendet [6].

Durch die direkte API-Integration entfällt das manuelle Kopieren von Daten. Stattdessen werden Informationen sicher und verschlüsselt in Ihre IT-Infrastruktur übertragen. Vor der Implementierung sollten klare Richtlinien definiert werden, welche Daten verarbeitet werden dürfen. Ergänzend dazu sollten technische und organisatorische Maßnahmen zur Datensicherheit umgesetzt werden [2][6].

Die Einführung von dexter health beinhaltet strukturierte Onboarding-Programme, die Pflegekräfte mit den Funktionen wie Sprachdokumentation und dem intelligenten Assistenten vertraut machen. Ziel ist es, die Kompetenz im Umgang mit KI zu stärken. Ihr Team sollte verstehen, wie KI arbeitet und welche Sicherheitsanforderungen dabei zu beachten sind.

Ein zentraler Punkt der Schulungen ist die Sensibilisierung für De-Anonymisierungsrisiken. Auch ohne direkte Namensnennung können Kombinationen aus Alter, Krankheitsbild und besonderen Merkmalen eine Identifizierung von Bewohnern ermöglichen [3]. Zudem wird vermittelt, dass private Smartphones oder öffentliche KI-Tools nicht für die Dokumentation von Bewohnerdaten genutzt werden dürfen [3].

Lars Werner, ein externer Datenschutzbeauftragter für Pflegeeinrichtungen, bringt es treffend auf den Punkt:

„Das Problem ist nicht die Technologie. Das Problem ist die Organisation." [3]

Um mit den sich schnell ändernden Risiken der KI-Technologie Schritt zu halten, sind regelmäßige Auffrischungsworkshops erforderlich. Diese Schulungen sollten die zweckgebundene Nutzung von Bewohnerdaten betonen: Daten dürfen ausschließlich für dokumentierte Pflegezwecke verwendet werden – nicht für das Training externer KI-Modelle [2][1].

Im nächsten Abschnitt wird ein Vergleich zwischen dexter health und öffentlichen KI-Tools gezogen.

| Merkmal | Öffentliche KI-Tools (z. B. ChatGPT) | dexter health |

|---|---|---|

| DSGVO-Konformität | Praktisch unmöglich für personenbezogene Daten [2] | Vollständig durch AVV und EU-basierte Verarbeitung [2] |

| Datenverarbeitung | Hauptsächlich USA-Server (Risikotransfer) [2][1] | EU-/Deutschland-Server |

| Modelltraining | Nutzt Eingaben standardmäßig für Training [1] | Keine Nutzung sensibler Bewohnerdaten [1] |

| Systemintegration | Manuelles Kopieren (Datenverlust-Risiko) [3] | Direkte API-Integration |

| Prüfungssicherheit | Hohes Risiko bei MDK-Prüfungen [3] | Konzipiert für Pflegedokumentationsstandards |

| Gerätenutzung | Oft auf privaten Smartphones (unkontrolliert) [3] | Auf sicheren, einrichtungsverwalteten Geräten |

Die Tabelle zeigt deutlich, warum spezialisierte, DSGVO-konforme Lösungen wie dexter health, die speziell für den Gesundheitssektor entwickelt wurden, die bessere Wahl für Pflegeeinrichtungen sind.

Der Einsatz öffentlicher KI-Tools wie ChatGPT in der Pflegedokumentation bringt erhebliche Datenschutzrisiken mit sich. Frühere Fälle zeigen, wie schnell sensible Informationen unkontrolliert preisgegeben werden können [1].

Die rechtlichen Folgen solcher Datenschutzverletzungen sind schwerwiegend: Verstöße gegen die DSGVO können zu Bußgeldern von bis zu 4 % des Jahresumsatzes führen. Gleichzeitig gefährden solche Vorfälle das Vertrauen von Angehörigen und können sich negativ auf MDK-Prüfungsergebnisse auswirken [5][3]. Um diese Risiken zu minimieren, sind spezialisierte, DSGVO-konforme Dokumentationslösungen unerlässlich.

Eine Lösung bieten spezialisierte Tools wie dexter health, die speziell für den Gesundheitssektor entwickelt wurden. Diese stellen sicher, dass Bewohnerdaten ausschließlich auf geschützten EU-Servern gespeichert werden, nicht für Trainingszwecke genutzt werden und über sichere API-Integrationen nahtlos in bestehende IT-Systeme eingebunden sind [2].

Lars Werner, externer Datenschutzbeauftragter für Pflegeeinrichtungen, bringt es auf den Punkt:

„Das Problem ist nicht die Technologie. Das Problem ist die Organisation." [3]

Pflegeeinrichtungen müssen klare Richtlinien einführen, ihr Personal entsprechend schulen und auf professionelle Lösungen setzen. So können sie Effizienz und Datensicherheit gleichermaßen gewährleisten.

Ja, Pflegeheime sind verpflichtet, Vorfälle im Zusammenhang mit KI-Systemen unverzüglich zu melden. Der Einsatz von KI-Tools wie ChatGPT bringt potenzielle Datenschutzrisiken mit sich, insbesondere wenn sensible Informationen über Bewohner unbeabsichtigt preisgegeben werden. Solche Datenschutzverletzungen unterliegen einer gesetzlichen Meldepflicht und erfordern schnelles Eingreifen, um die Einhaltung rechtlicher Vorgaben sicherzustellen und mögliche Schäden zu begrenzen.

Bewohner können durch bestimmte Angaben wie Alter, Geschlecht, medizinische Zustände, Pflegebedarf, Wohnort oder spezifische Lebensumstände indirekt identifiziert werden. Wenn diese Informationen miteinander kombiniert werden, können sie Rückschlüsse auf die Identität einer Person zulassen und somit deren Datenschutz gefährden.

Um sicherzustellen, dass der Einsatz von KI den Datenschutzrichtlinien entspricht, ist es wichtig, ausschließlich Lösungen zu verwenden, die mit der DSGVO im Einklang stehen. Besonders sensible Daten sollten in geschützten Umgebungen verarbeitet werden – etwa auf lokalen Servern oder in zertifizierten Cloud-Diensten, die strenge Sicherheitsstandards erfüllen.

Ein weiterer zentraler Punkt ist die Einführung klarer interner Richtlinien. Diese legen fest, wie KI-Tools genutzt werden dürfen, und minimieren das Risiko von Fehlanwendungen. Ergänzend dazu sollten Mitarbeitende regelmäßig geschult werden, um ein Bewusstsein für den richtigen Umgang mit KI und den Datenschutz zu schaffen.

Auf diese Weise können Unternehmen die Möglichkeiten von KI optimal ausschöpfen, ohne Datenschutzvorgaben zu gefährden.