ChatGPT erkennt Dekubitus-Risiken aus SIS-Texten, zeigt Potenzial, aber Halluzinationen, Datenschutz- und Integrationsgrenzen bleiben.

ChatGPT zeigt Potenzial, Dekubitusrisiken anhand der SIS-Dokumentation zu analysieren, stößt jedoch auf technische und praktische Grenzen. Die wichtigsten Erkenntnisse:

Fazit: ChatGPT kann Pflegekräfte unterstützen, ersetzt aber keine Fachkompetenz. Es bleibt ein Werkzeug, das sorgfältig eingesetzt werden muss.

Die Patientenhistorie enthält entscheidende Informationen, um Dekubitusrisiken zu identifizieren. Zu den wichtigsten Faktoren gehören eingeschränkte Mobilität (wie unsicheres Gehen oder Bettlägerigkeit), unerklärter Gewichtsverlust, ein beeinträchtigter Ernährungsstatus (zum Beispiel Appetitverlust), chronische Erkrankungen (wie Diabetes oder Bluthochdruck) und bestehende Hautprobleme oder frühere Druckgeschwüre [1][2]. Mithilfe von NLP (Natural Language Processing) kann ChatGPT solche Risikofaktoren erkennen und in strukturierte Formate wie SOAP-Notizen oder SIS-Zusammenfassungen übertragen [2]. Ein Beispiel: Das System kann einen Gewichtsverlust von 86 kg auf 69 kg innerhalb von sechs Monaten als Risikofaktor identifizieren [1].

Allerdings zeigt sich ein zentrales Problem: die sogenannte "Hallucination". Dabei generiert ChatGPT manchmal Daten, die in den Originalunterlagen nicht vorhanden sind, wie Alter oder Diagnosen – selbst wenn explizit darauf hingewiesen wird, keine Rückschlüsse zu ziehen [1].

"The most concerning issue was the model's insistence on making-up not specified data like age or diagnosis, despite direct instructions not to make inferences."

– Grace Potma, OpenMRS Director of Product [1]

Diese Problematik unterstreicht die Notwendigkeit weiterer Studien, um ChatGPTs Fähigkeiten im medizinischen Kontext genauer zu bewerten.

Tests mit drei Modellen (GPT-4o, GPT-4o-mini und o1-preview) im Jahr 2024 zeigten, dass ChatGPT bei der Verarbeitung von Patientendaten weiterhin Schwächen aufweist [1]. Während GPT-4o im Vergleich zu günstigeren Modellen wie GPT-4o-mini klinisch präzisere Zusammenfassungen liefert, bleibt das Risiko für Fehlinformationen hoch [1]. Eine Oxford-Studie aus dem Februar 2026 ergab, dass ChatGPT allein eine Diagnosegenauigkeit von 94,9 % erreichte. Doch sobald Menschen in den Prozess eingebunden wurden, sank die Genauigkeit auf lediglich 34,5 % [3]. Zudem waren nur 34 % der mehrfach vorgeschlagenen Diagnosen korrekt [3].

Ein weiteres Problem zeigte sich darin, dass 53 % der Studienteilnehmer nicht alle relevanten Symptome angaben. ChatGPT stellte in diesen Fällen keine gezielten Rückfragen, um fehlende Informationen zu ergänzen [3].

Für die SIS-Dokumentation bedeutet dies: Obwohl ChatGPT Muster in den Anamnesedaten erkennen kann, ist ohne spezialisierte medizinische Modelle und strenge Qualitätskontrollen das Risiko für fehlerhafte Risikobewertungen von Dekubitus weiterhin hoch.

Eingeschränkte Mobilität gilt als einer der Hauptfaktoren, die das Risiko für Dekubitus erhöhen. Wenn Patienten ihre Position nicht selbstständig verändern können, übt das Körpergewicht kontinuierlich Druck auf bestimmte Hautstellen aus – besonders an empfindlichen Bereichen wie Fersen, Ellenbogen, Hüften und Steißbein [4]. Dieser Druck kann die Durchblutung so stark beeinträchtigen, dass bereits nach zwei Stunden Gewebeschäden auftreten können [5]. Druckgeschwüre stellen ein ernstes globales Gesundheitsproblem dar und können in schweren Fällen sogar lebensbedrohlich werden [5].

Das SIS-Themenfeld 2 (Mobilität und Beweglichkeit) dokumentiert genau diese Aspekte: Ist der Patient bettlägerig oder auf einen Rollstuhl angewiesen? Kann er seine Position eigenständig ändern? Weitere Faktoren wie Reibung, Feuchtigkeit, Hautdehnung durch Rutschen sowie Druckstellen durch Hilfsmittel wie Gipsverbände oder Prothesen spielen ebenfalls eine Rolle [5][6].

ChatGPT kann solche Informationen aus der Dokumentation herausziehen und analysieren. Die entscheidende Frage bleibt jedoch: Kann das System die Verbindungen zwischen eingeschränkter Mobilität und der daraus resultierenden verminderten Durchblutung präzise erkennen, um verlässliche Risikoeinschätzungen zu ermöglichen? Eine genaue Erfassung der Mobilität ist essenziell, um Risikoskalen wie die Braden-Skala effektiv einzusetzen.

Die Braden-Skala bietet einen standardisierten Ansatz zur Bewertung des Dekubitusrisikos und baut auf der Analyse mobilitätsbezogener Risiken auf. Entwickelt 1987 von Barbara Braden und Nancy Bergstrom, ist sie das am häufigsten genutzte Instrument zur Dekubitusprävention in den USA [8]. Die Skala umfasst sechs Kategorien, darunter „Mobilität“ und „Aktivität“, die jeweils mit 1 bis 4 Punkten bewertet werden. Die Gesamtpunktzahl bestimmt das Risikoniveau: Werte unter 9 deuten auf ein schweres Risiko hin, während 10–12 ein hohes Risiko anzeigen [8].

Die Kategorie „Mobilität“ bewertet, ob der Patient seine Position eigenständig ändern kann. Eine Bewertung von 1 („vollständig immobil“) bedeutet, dass keine Positionswechsel ohne Hilfe möglich sind, während eine Bewertung von 2 („sehr eingeschränkt“) nur minimale, gelegentliche Bewegungen zulässt [7]. Die Kategorie „Aktivität“ hingegen bewertet, wie aktiv der Patient ist – etwa ob er bettlägerig ist oder regelmäßig geht [8].

Eine Studie aus dem Jahr 2022 zeigte, dass die Braden-Skala bei der Bewertung von Mobilität und Aktivität zuverlässige Ergebnisse liefert und eine gute Grundlage für präventive Maßnahmen darstellt [9]. Für ChatGPT bedeutet dies: Das strukturierte Punktesystem der Skala könnte genutzt werden, um qualitative Pflegebeschreibungen in messbare Daten umzuwandeln [8].

„Die Braden-Skala ist nur so genau wie die Person, die sie anwendet. Und wenn Interventionen identifiziert, aber nicht konsequent umgesetzt werden, kann trotzdem ein Dekubitus entstehen."

– Holly M. Hovan, MSN, APRN, GERO-BC, CWOCN-AP [7]

Dieses Zitat hebt ein zentrales Problem hervor: Auch wenn ChatGPT eine korrekte Risikobewertung liefert, bleibt die Umsetzung durch Pflegekräfte entscheidend. Zudem ist eine präzise Dokumentation notwendig, etwa ob ein Patient im Rollstuhl regelmäßig sein Gewicht verlagert oder ob im Bett alle ein bis zwei Stunden eine Umlagerung erfolgt. Nur so kann ein KI-System verlässliche Einschätzungen treffen [5].

Im Themenfeld 3 steht die Ernährung im Fokus, da sie eine entscheidende Rolle bei der Risikobewertung spielt. Untergewicht beispielsweise kann die Schutzfunktion des Gewebes beeinträchtigen, wodurch die Haut empfindlicher gegenüber Druck wird [4]. ChatGPT ist in der Lage, solche Informationen aus Pflegedokumentationen zu extrahieren.

Ein Blick auf spezialisierte KI-Systeme zeigt deren Potenzial: Am Mount Sinai Hospital wurde 2022 das Pressure Injury Prevention Artificial Intelligence (PIPAI) Tool entwickelt. Dieses System analysiert über 300 klinische Datenpunkte, darunter Ernährungs- und Hydrationsstatus, und erwies sich als 50 % präziser als die Braden-Skala bei der Identifikation von Risikopatienten. Zudem führte es zu einem 9 % höheren Anteil an Patienten, die ohne Druckgeschwüre entlassen wurden [10].

"Traditional methods miss more than half of patients who will develop pressure injuries. We need to create a tool to be more proactive in prevention rather than reactive after a pressure injury happens."

– Kim-Anh-Nhi Nyugen, Senior Clinical Data Scientist, Icahn School of Medicine at Mount Sinai [10]

Obwohl solche spezialisierten Systeme beeindruckende Ergebnisse liefern, bleibt unklar, ob ChatGPT als generalistisches Sprachmodell ähnliche Präzision erreichen kann. Nach der Analyse der Ernährungsdaten wird im nächsten Abschnitt untersucht, wie ChatGPT Inkontinenzinformationen für die Risikobewertung nutzt.

Themenfeld 4 beleuchtet die Auswirkungen von Inkontinenz auf das Dekubitusrisiko. Inkontinenz kann die Haut schädigen und sie anfälliger für Reibung und Scherkräfte machen [4]. ChatGPT müsste in der Lage sein, auch unvollständige oder mehrdeutige Angaben zu interpretieren. Ein weiterer wichtiger Punkt: Die Erkennung von Dekubitus-Symptomen variiert je nach Hautton. Während bei heller Haut rote Flecken typische Anzeichen sind, treten bei dunkler Haut oft violette oder blaue Verfärbungen auf [4]. Da Druckgeschwüre innerhalb weniger Stunden entstehen können, sollte die Dokumentation auch Hinweise auf warme, schwammige oder verhärtete Hautstellen enthalten [4].

Im Themenfeld 5 geht es um die kognitive und kommunikative Situation von Patienten. Ein Problem hierbei: Patienten, die Druck oder Schmerz nicht wahrnehmen, können frühe Symptome oft nicht melden [4]. In solchen Fällen wäre es wichtig, dass ChatGPT objektive Beobachtungen der Haut stärker gewichtet als subjektive Angaben.

Neuere Modelle wie GPT-5 zeigen Fortschritte in der Erkennung von psychischen Belastungen, Psychosen und Manien. Sie reduzierten unerwünschte Antworten um 65–80 % und erzielten eine Compliance von 92 % bei gewünschten Verhaltensweisen in psychischen Notfällen – ein deutlicher Fortschritt im Vergleich zu früheren Modellen, die nur 27 % erreichten [11].

Dennoch gibt es ethische Herausforderungen. Eine Studie identifizierte 15 Risiken bei KI-Therapie-Chatbots, darunter "deceptive empathy" und unzureichendes Krisenmanagement [12]. Zudem zeigen KI-Modelle häufig Vorurteile gegenüber bestimmten Erkrankungen wie Schizophrenie oder Alkoholabhängigkeit, was die Risikobewertung verzerren könnte [13].

"When LLM counselors make these violations, there are no established regulatory frameworks."

– Zainab Iftikhar, Ph.D. candidate, Brown University [12]

Neben psychischen Aspekten spielen auch Einschränkungen in der Selbstpflege eine Rolle bei der Risikobewertung.

Themenfeld 6 untersucht die Selbstpflegefähigkeit, die eng mit Mobilität verbunden ist. Einschränkungen in der Bewegung sind eine Hauptursache für Dekubitus, da langanhaltender Druck auf bestimmte Körperstellen ausgeübt wird [4]. ChatGPT kann solche Einschränkungen in den Aktivitäten des täglichen Lebens analysieren und in die Risikobewertung einfließen lassen.

Auch wenn KI-Systeme hier unterstützend wirken, ersetzen sie nicht die Überprüfung durch Pflegekräfte [13][12]. Die endgültige Risikobeurteilung sollte stets von qualifiziertem Personal vorgenommen werden, da KI-Modelle derzeit in einem regulatorischen Vakuum ohne klare Haftungsregelungen arbeiten [12].

ChatGPT Diagnosegenauigkeit: Theorie vs. Praxis in der Dekubitus-Risikoerkennung

Die Qualität der SIS-Dokumentation hängt maßgeblich von präzisen und vollständigen Eingaben ab – und genau hier zeigt sich, wie ChatGPT abschneidet. Theoretisch bringt das System viel Potenzial mit, doch praktische Tests decken deutliche Schwächen auf. Eine Studie der University of Oxford aus Februar 2026 zeigt, dass ChatGPT (GPT-4o) in simulierten Szenarien eine beeindruckende Genauigkeit von 94,9 % bei der Erkennung korrekter Diagnosen erreichte. Sobald es jedoch in echten medizinischen Entscheidungssituationen eingesetzt wurde, sank diese Quote drastisch auf 34,5 % [3]. Auch bei der Triage-Genauigkeit blieb die Leistung mit 44,2 % nur knapp über der von traditionellen Methoden, die bei 43 % liegen [3].

Diese Diskrepanz verdeutlicht, wie wichtig vollständige Eingaben für die Verlässlichkeit sind. Die folgende Tabelle fasst zentrale Studienergebnisse zusammen und zeigt Schwachstellen auf:

| Studie | Stichprobengröße | Fokus / Themenfeld | Genauigkeitsrate | Haupteinschränkungen |

|---|---|---|---|---|

| University of Oxford (Feb. 2026) [3] | 1.298 Teilnehmer | Medizinische Triage & Diagnose (Allgemeine Gesundheitsrisiken) | 34,5 % (Mensch+KI) | Unvollständige Informationen in 53 % der Fälle; keine Rückfragen durch die KI; inkonsistente Ergebnisse bei gleichen Symptomen |

| Giakas et al. (Sep. 2024) [14] | 10 Standardfragen | Wirbelsäulenchirurgie (Präoperative Risiken/Anamnese) | ~59 % (Qualitätsscore) | Fehlender patientenspezifischer Kontext; unklare Aussagen zu „Patientenpräferenzen"; potenziell irreführend |

| GPT-5 Benchmark (Jan. 2026) [15] | 15.908 Fragen | MMLU Pro (Akademisches/Medizinisches Wissen) | 87,0 % | 13 % Fehlerquote bei komplexen Aufgaben; 4,8 % Halluzinationsrate |

Ein Hauptproblem liegt in unvollständigen Angaben: In 53 % der Fälle behinderten fehlende Informationen die Risikobewertung. ChatGPT stellt zudem selten Rückfragen, um diese Lücken zu schließen [3]. Die Forscher der Oxford-Studie betonten:

"Standard benchmarks for medical knowledge and simulated patient interactions do not predict the failures we find with human participants."

– University of Oxford Researchers, Nature Medicine [3]

Das neuere Modell GPT-5 zeigt zwar Fortschritte und reduziert Faktenfehler um 45 % im Vergleich zu GPT-4o, dennoch bleiben etwa 13 % der Antworten bei komplexen Tests fehlerhaft [15]. Für die SIS-Dokumentation bedeutet das: Die Genauigkeit der Ergebnisse hängt direkt von der Qualität der eingegebenen Daten ab.

Neben den quantitativen Ergebnissen gibt es auch technische und rechtliche Herausforderungen, die nicht ignoriert werden können. ChatGPT ist nicht HIPAA-konform und darf daher keine geschützten Gesundheitsdaten verarbeiten [16]. Das Eingeben von Patientendaten wie Namen, Geburtsdaten oder spezifischen Diagnosen birgt erhebliche Datenschutzrisiken.

Zudem bleibt die Halluzinationsrate ein Problem: Mit 4,8 % Wahrscheinlichkeit generiert ChatGPT falsche, aber glaubwürdig klingende klinische Informationen [15][16][17]. Professorin Lorelei Lingard warnt:

"In machine learning terms, it can 'hallucinate', confidently presenting legitimate-sounding material that it is not real."

– Lorelei Lingard, Professor and Researcher [17]

Für Bereiche wie die Dekubitus-Risikoerkennung, bei denen höchste Präzision erforderlich ist, stellt dies ein erhebliches Hindernis dar. Hinzu kommt, dass ChatGPT keine klinische Urteilsfähigkeit besitzt: Es kann keine Patienten sehen, keine Körpersprache deuten und keine subtilen Warnzeichen erkennen, die einer geschulten Pflegekraft bei einer physischen Untersuchung auffallen würden [16].

Ein weiterer Nachteil ist, dass ChatGPT nicht mit elektronischen Patientenakten verbunden ist. Pflegekräfte müssen Daten manuell kopieren und einfügen, was das Risiko menschlicher Fehler und unbeabsichtigter Datenlecks erhöht [16]. Außerdem liegt die rechtliche Verantwortung für fehlerhafte Inhalte vollständig beim Pflegedienstleister, nicht beim Entwickler der KI [16].

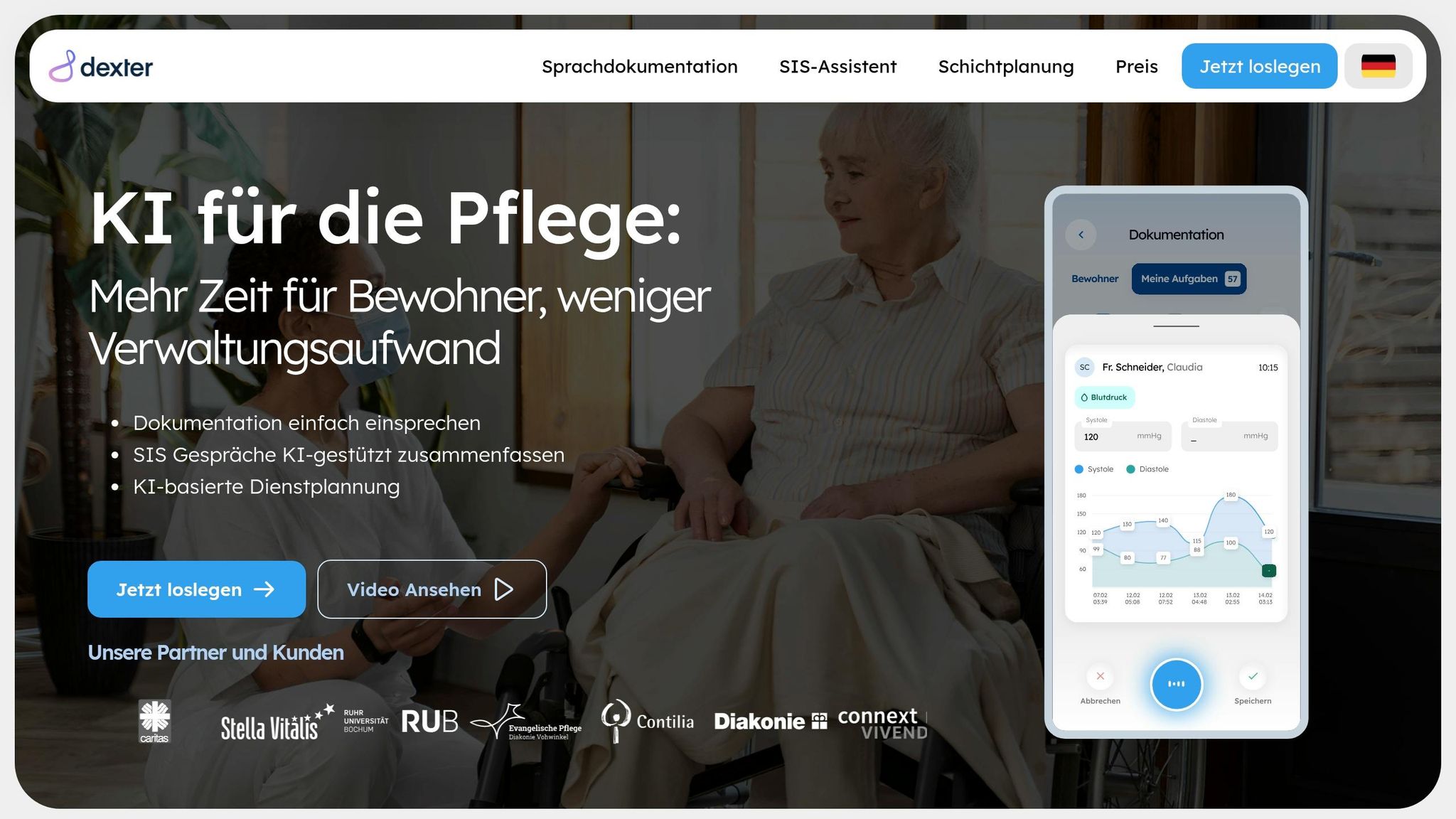

Eine genaue und vollständige Pflegedokumentation ist essenziell für MDK-Prüfungen. KI-gestützte Tools können dabei helfen, den Verwaltungsaufwand erheblich zu verringern. Durch automatische Verarbeitung von Gesprächen, Arztbesuchen und Risikobewertungen werden relevante Informationen zeitsparend aufbereitet. Das bedeutet, Pflegekräfte können ihre Energie stärker auf die direkte Betreuung von Bewohnern konzentrieren. Der von der KI erstellte Entwurf dient als solide Basis, die von Fachkräften geprüft und finalisiert wird. Dieser Ansatz verbessert nicht nur die Qualität der Dokumentation, sondern sorgt auch dafür, dass alle Unterlagen vollständig sind. Diese Zeitersparnis macht den Weg frei für den Einsatz moderner Softwarelösungen in der Pflege.

Dexter health hat einen speziell entwickelten SIS-Assistenten, der gezielt auf die Anforderungen der deutschen Pflegedokumentation eingeht. Das System arbeitet DSGVO-konform und schützt sensible Gesundheitsdaten. Es zeichnet automatisch Gespräche zwischen Pflegekräften, Bewohnern und Ärzten auf und erstellt daraus einen ersten Entwurf der Strukturierten Informationssammlung (SIS). Gleichzeitig wird eine vorläufige Risikoanalyse durchgeführt, die auf den besprochenen Themenfeldern basiert. Pflegekräfte können diese Entwürfe individuell überprüfen und anpassen, wodurch ihre Fachkompetenz weiterhin im Mittelpunkt steht. Gleichzeitig werden zeitintensive Verwaltungsaufgaben reduziert. Der Assistent unterstützt zudem die Pflegebegutachtung nach Expertenstandards, was eine optimale Vorbereitung auf MDK-Prüfungen gewährleistet [18].

ChatGPT zeigt vielversprechende Fähigkeiten bei der Analyse von Pflegedokumentationen und kann Risikofaktoren für Dekubitus in den SIS-Themenfeldern 1 bis 6 identifizieren. Die KI ist in der Lage, unstrukturierte Pflegenotizen systematisch zu analysieren und den entsprechenden Themenfeldern zuzuordnen. Allerdings bleibt sie auf textbasierte Daten begrenzt und kann körperliche Untersuchungen nicht ersetzen. Ein weiteres Risiko besteht in sogenannten Halluzinationen – also Angaben, die zwar plausibel klingen, aber inhaltlich falsch sind. In der klinischen Praxis kann dies schwerwiegende Folgen haben [19].

Um die Stärken und Schwächen von ChatGPT optimal zu nutzen, ist eine gezielte Integration in bestehende technische Systeme notwendig. Ein vielversprechender Ansatz ist die Kombination allgemeiner KI-Modelle wie ChatGPT mit spezialisierten Pflegelösungen. Der SIS-Assistent von dexter health setzt beispielsweise auf eine DSGVO-konforme, vernetzte Dokumentation, die Widersprüche frühzeitig erkennt und dabei die relevanten Expertenstandards berücksichtigt.

Trotz der Unterstützung durch KI bleibt die menschliche Expertise unverzichtbar. KI kann Pflegekräfte zwar bei zeitaufwändigen Verwaltungsaufgaben entlasten, ersetzt jedoch nicht deren Fachwissen. Die abschließende Prüfung und Anpassung der Dokumentation muss weiterhin durch qualifiziertes Personal erfolgen, um sicherzustellen, dass die menschliche Beurteilung im Mittelpunkt bleibt und gleichzeitig die Effizienz gesteigert wird.

Die Erkenntnisse aus den SIS-Themenfeldern bilden die Grundlage für die Weiterentwicklung der Pflegedokumentation. Zukünftige Fortschritte werden sich auf eine bessere Integration mit vorhandener Pflegesoftware, genauere Risikoerkennung, höhere Datensicherheit und eine stärkere Anpassung an deutsche Pflegestandards konzentrieren.

Die vorhandenen Informationen lassen offen, welche spezifischen SIS-Daten (Strukturierten Informationssammlungen) ChatGPT benötigt, um das Risiko für Dekubitus zuverlässig zu bewerten. Es bleibt unklar, wie präzise ChatGPT solche Risiken auf Basis der SIS-Daten einschätzen kann.

Um Halluzinationen zu vermeiden, ist es entscheidend, dass die Eingabedaten präzise und zuverlässig sind. Eine klar definierte, strukturierte Dokumentation mit standardisierten Kriterien hilft, Interpretationsspielräume der KI zu minimieren. Gleichzeitig sollten Pflegefachkräfte die automatisierten Bewertungen kritisch hinterfragen und regelmäßig mit ihrem eigenen Fachwissen abgleichen. So lässt sich die Genauigkeit der Risikoanalyse verbessern und das Risiko von Fehlinterpretationen deutlich reduzieren.

Damit eine Integration den Vorgaben der DSGVO entspricht, dürfen personenbezogene Daten nur auf einer rechtlichen Grundlage verarbeitet werden. Dies kann beispielsweise durch die Einwilligung der Pflegebedürftigen erfolgen. Dabei sollte die KI ausschließlich Daten nutzen, die für den jeweiligen Zweck relevant sind, und diese nur vorübergehend speichern. Der Grundsatz der Datenminimierung ist dabei entscheidend.

Technische Maßnahmen spielen eine zentrale Rolle: Dazu gehören Verschlüsselung, Zugriffskontrollen und regelmäßige Sicherheitsprüfungen, um die Daten bestmöglich zu schützen. Ebenso wichtig ist es, Transparenz zu gewährleisten. Dokumentierte Prozesse sorgen dafür, dass die Einhaltung der Datenschutzvorgaben nachvollziehbar bleibt und gleichzeitig die Qualität der Pflege unterstützt wird.