Übersicht zu DSGVO, EU AI Act, Haftung, Transparenzpflichten und praktischen Compliance-Maßnahmen für KI-gestützte Pflegedokumentation.

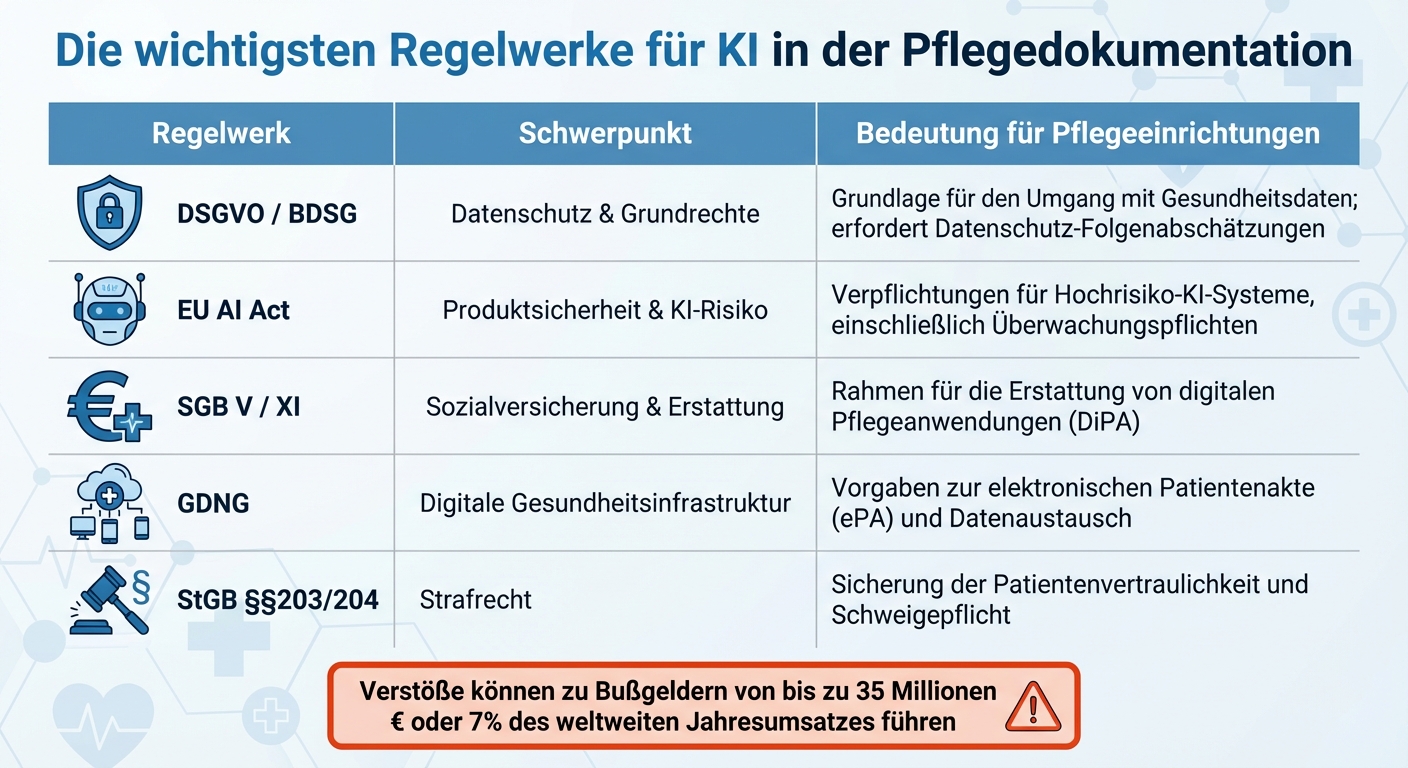

In Deutschland unterliegt der Einsatz von KI in der Pflegedokumentation strengen rechtlichen Vorgaben. Datenschutz und Patientensicherheit stehen im Mittelpunkt. Verstöße gegen die DSGVO oder den EU AI Act können zu Bußgeldern von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes führen. Ab 2025 gelten zudem neue Pflichten, wie Schulungen für Pflegekräfte zur sicheren Nutzung von KI-Systemen.

Wichtige Regelwerke, die Pflegeeinrichtungen beachten müssen, umfassen:

Pflegeeinrichtungen müssen zudem sicherstellen, dass KI-Systeme transparent, sicher und nachvollziehbar arbeiten. Die Einhaltung dieser Anforderungen erfordert technische Maßnahmen, wie automatische Logging-Systeme, und organisatorische Vorkehrungen, wie regelmäßige Mitarbeiterschulungen. Ab August 2026 treten weitere Transparenzpflichten und Marktüberwachungsregeln in Kraft.

Wichtig: Die Verantwortung für KI-Entscheidungen liegt bei den Pflegeeinrichtungen, während Hersteller für technische Mängel haften. Eine gründliche Dokumentation und Schulung der Mitarbeitenden sind entscheidend, um rechtliche Risiken zu minimieren.

Rechtliche Regelwerke für KI in der Pflegedokumentation: DSGVO, EU AI Act und weitere Vorgaben im Überblick

Der Einsatz von KI in der Pflegedokumentation wird durch eine Vielzahl europäischer und deutscher Gesetze geregelt, die den rechtmäßigen Umgang mit sensiblen Daten und die Sicherheit solcher Systeme sicherstellen.

Drei Hauptregelwerke bilden das Fundament: Die DSGVO (zusammen mit dem BDSG) schützt Gesundheitsdaten, der EU AI Act legt Sicherheitsanforderungen für KI-Systeme fest, und das SGB V, SGB XI sowie das GDNG regeln die Integration digitaler Technologien in das deutsche Gesundheitssystem.

| Regelwerk | Schwerpunkt | Bedeutung für Pflegeeinrichtungen |

|---|---|---|

| DSGVO / BDSG | Datenschutz & Grundrechte | Grundlage für den Umgang mit Gesundheitsdaten; erfordert Datenschutz-Folgenabschätzungen |

| EU AI Act | Produktsicherheit & KI-Risiko | Verpflichtungen für Hochrisiko-KI-Systeme, einschließlich Überwachungspflichten |

| SGB V / XI | Sozialversicherung & Erstattung | Rahmen für die Erstattung von digitalen Pflegeanwendungen (DiPA) |

| GDNG | Digitale Gesundheitsinfrastruktur | Vorgaben zur elektronischen Patientenakte (ePA) und Datenaustausch |

| StGB §§203/204 | Strafrecht | Sicherung der Patientenvertraulichkeit und Schweigepflicht |

Im Folgenden werden die zentralen Regelwerke und ihre Auswirkungen näher beleuchtet. Dabei zeigt sich bereits in der Praxis, wie KI-Tools die SIS-basierte Pflegeplanung rechtssicher unterstützen können.

Die DSGVO ist das zentrale Regelwerk für den Schutz personenbezogener Daten, insbesondere sensibler Gesundheitsdaten, die gemäß Art. 9 der DSGVO als „besondere Kategorie“ gelten. Ihre Verarbeitung ist grundsätzlich untersagt, es sei denn, es liegt eine Ausnahme wie die ausdrückliche Einwilligung (Art. 9 Abs. 2 lit. a) oder die medizinische Notwendigkeit (Art. 9 Abs. 2 lit. h) vor.

Pflegeeinrichtungen, die KI-Systeme nutzen, müssen eine Datenschutz-Folgenabschätzung (DPIA) durchführen und Transparenz gewährleisten – eine Herausforderung bei komplexen KI-Modellen, die oft als „Black Box“ wahrgenommen werden. Philipp Müller-Peltzer von der Kanzlei Schürmann Rosenthal Dreyer betont:

„Die Verarbeitung personenbezogener Daten muss daher auf Art. 6 oder Art. 9 der DSGVO beruhen."

Ein weiterer kritischer Punkt ist die Datenrichtigkeit (Art. 5 Abs. 1 lit. d). Fehlerhafte KI-Berichte können rechtliche Konsequenzen und Pflegefehler nach sich ziehen, weshalb eine MD-konforme Dokumentation essenziell ist. Verstöße gegen die DSGVO können mit Bußgeldern von bis zu 20 Millionen Euro oder 4 % des weltweiten Jahresumsatzes geahndet werden [3].

Neben den datenschutzrechtlichen Vorgaben regeln das SGB V, SGB XI und das GDNG, wie digitale Technologien in die Gesundheitsversorgung integriert werden. Seit Dezember 2022 können digitale Pflegeanwendungen (DiPA) – einschließlich KI-gestützter Tools – von der Pflegeversicherung erstattet werden, sofern sie strenge Vorgaben zu Sicherheit, Qualität und Datenschutz erfüllen. Bis Anfang 2025 hat das BfArM bereits 65 medizinische Apps zur Erstattung zugelassen [3].

Das GDNG treibt zudem die Einführung der elektronischen Patientenakte (ePA) voran, die ab 2025 schrittweise eingeführt wird. Zu den ersten Funktionen gehören Medikationslisten und Diagnosebefunde. Pflegeeinrichtungen müssen sicherstellen, dass ihre KI-Systeme mit der ePA kompatibel sind [3].

Der EU AI Act, der seit dem 1. August 2024 gilt, verfolgt einen risikobasierten Ansatz und teilt KI-Systeme in vier Kategorien ein: Unzulässig, Hochrisiko, Mittleres Risiko und Geringes Risiko [9]. Für die Pflege sind vor allem Hochrisiko-Systeme relevant, wie KI-gestützte Entscheidungshilfen oder Diagnosewerkzeuge.

Betreiber solcher Hochrisiko-Systeme müssen geschultes Personal bereitstellen, Vorfälle melden und menschliche Aufsicht sicherstellen. Anbieter müssen zudem Risikomanagementsysteme implementieren, hochwertige Datensätze nutzen und eine CE-Kennzeichnung erlangen [8][10].

„Hochrisiko-KI-Systeme, wie KI-basierte Software für medizinische Zwecke, müssen mehrere Anforderungen erfüllen, darunter Risikominderungssysteme, hochwertige Datensätze, klare Benutzerinformationen und menschliche Aufsicht."

– Europäische Kommission [8]

Einige Verbote für KI-Praktiken mit „unannehmbarem Risiko“, wie die Emotionserkennung am Arbeitsplatz, gelten bereits seit Februar 2025. Die vollständigen Anforderungen für Hochrisiko-Systeme, die in regulierte Produkte wie Medizingeräte integriert sind, werden jedoch erst ab August 2027 verpflichtend [8].

Die Verarbeitung von Gesundheitsdaten mit KI-Systemen erfordert besonders strenge Sicherheitsvorkehrungen, die über die allgemeinen Anforderungen der DSGVO hinausgehen. Pflegeeinrichtungen stehen dabei vor der Herausforderung, sensible Bewohnerdaten sicher zu verwalten – egal, ob diese in der Cloud oder lokal gespeichert werden.

Wie bereits im Abschnitt „DSGVO: Datenschutz und KI-Dokumentation" beschrieben, ist eine Datenschutz-Folgenabschätzung (DPIA) gemäß Art. 35 DSGVO verpflichtend. Dies gilt insbesondere, da KI-Systeme als „innovative Technologie" eingestuft werden und mit sensiblen personenbezogenen Daten arbeiten [13]. Die DPIA dient dazu, Risiken der Datenverarbeitung zu bewerten und Schutzmaßnahmen zu dokumentieren. Gerade bei Gesundheitsdaten ist besondere Vorsicht geboten, da unbefugte Zugriffe schwerwiegende Folgen haben können.

Die Prinzipien der Datenminimierung und Zweckbindung sind bei Gesundheitsdaten besonders wichtig. Technologien wie Federated Learning bieten hier eine Lösung, da sie es ermöglichen, Modelle lokal zu trainieren, ohne sensible Rohdaten zentralisieren zu müssen [7].

„Die Leistungsfähigkeit von KI-Systemen hängt maßgeblich von der Qualität der zugrunde liegenden Daten ab... Diese Daten enthalten oft personenbezogene Informationen, die durch die strengen Bestimmungen der Datenschutz-Grundverordnung (DSGVO) geschützt sind."

– Philipp Müller-Peltzer, Rechtsanwalt [7]

Ein weiterer entscheidender Punkt ist die Intervenierbarkeit: Bewohner haben gemäß Art. 17 DSGVO das Recht, ihre Daten löschen zu lassen. Mithilfe von „Machine Unlearning“ können KI-Systeme einzelne Datenpunkte entfernen, ohne das gesamte Modell neu trainieren zu müssen [11]. Auch die Wahl der Hosting-Option – Cloud oder lokal – muss den spezifischen Datenschutzanforderungen entsprechen.

Die Entscheidung zwischen Cloud- und lokaler Infrastruktur hat erhebliche Auswirkungen auf die Einhaltung von Datenschutzvorschriften. Ab dem 1. Juli 2024 gelten durch § 393 SGB V strengere Regeln für Cloud-Dienste im Gesundheitswesen, die etwa 90 % der deutschen Bevölkerung betreffen [14].

Ein Vergleich der beiden Hosting-Optionen zeigt die Unterschiede:

| Merkmal | Cloud-basiertes Hosting | On-Premise Hosting |

|---|---|---|

| Datenkontrolle | Verarbeitung auf Servern des Anbieters; erfordert einen Auftragsverarbeitungsvertrag (Art. 28 DSGVO) [12] | Daten verbleiben in der lokalen Infrastruktur; physische Kontrolle durch die Einrichtung [5] |

| Compliance | Muss § 393 SGB V erfüllen und ein C5-Type-2-Testat vorlegen [12] | Erfüllt allgemeine IT-Sicherheitsanforderungen nach Art. 32 DSGVO; kein C5-Testat nötig [5] |

| Territorialität | Verarbeitung nur in Deutschland, EU/EWR oder Ländern mit Angemessenheitsbeschluss; deutsche Niederlassung erforderlich [12] | Daten bleiben vor Ort, daher territoriale Konformität [5] |

| Wartung | Sicherheitsupdates durch den Anbieter; „Data Protection by Design" integriert [12] | Pflegeeinrichtung übernimmt technische und organisatorische Maßnahmen (TOMs) eigenständig [11] |

| Risikoprofil | Erhöhtes Risiko durch internetbasierte Systeme und mögliche Drittzugriffe [5] | Geringeres Risiko externer Datenlecks; gilt als „geschlossenes System" [5] |

Ab dem 1. Juli 2025 müssen Cloud-Anbieter ein aktuelles C5-Type-2-Testat des BSI vorlegen, um die Einhaltung der Sicherheitsstandards für Gesundheitsdaten nachzuweisen [12].

„Wenn Gesundheits- und Sozialdaten außerhalb Deutschlands verarbeitet werden, muss die datenverarbeitende Stelle auch eine Niederlassung in Deutschland unterhalten."

Für besonders sensible Bereiche wie die Pflege empfehlen Datenschutzbehörden „geschlossene Systeme". Diese verhindern, dass Eingabedaten für das Training von Drittanbieter-Modellen genutzt werden, und bieten so einen höheren Schutz [5].

In Deutschland hat ein KI-System keine eigene Rechtspersönlichkeit. Das bedeutet, dass die Haftung in der Regel bei der Pflegeeinrichtung als Nutzer liegt. Gleichzeitig trägt der Hersteller Verantwortung: Laut der EU-Produkthaftungsrichtlinie gelten Software und KI-Modelle als „Produkte“. Treten Mängel auf, greift die sogenannte Beweislastumkehr. Das heißt, der Hersteller muss nachweisen, dass kein Zusammenhang zwischen dem Produkt und dem Schaden besteht[16][17].

„Der Nutzer haftet immer für die von der KI generierten Inhalte – im Zweifel das Unternehmen, das KI-generierte Texte und Bilder in seinem Namen verwendet."

– Marlene Schreiber, Partnerin und Fachanwältin für IT-Recht[16]

Für Hochrisiko-KI-Systeme, wie sie im Gesundheitswesen verwendet werden, schreibt der EU AI Act eine menschliche Aufsicht vor. Das bedeutet, dass die endgültige Entscheidung immer bei einem Menschen liegen muss[4]. Der Bundesgerichtshof hat am 8. Februar 2022 zudem klargestellt, dass ein blindes Vertrauen in fehlerhafte KI-Dokumentationen, das zu groben Behandlungsfehlern führt, die Haftung erhöhen kann[15]. Diese Regelungen machen deutlich, wie wichtig es ist, häufige Haftungsquellen zu kennen und die Dokumentationspflichten sowie die Dokumentationsqualität genau einzuhalten.

Es gibt mehrere Haftungsquellen, die im Zusammenhang mit KI-Dokumentationen auftreten können:

| Haftungsquelle | Primär verantwortlich | Rechtsgrundlage |

|---|---|---|

| Fehlerhafte Dokumentationsinhalte | Nutzer / Pflegeeinrichtung | BGB (Bürgerliches Gesetzbuch) |

| Technischer Systemdefekt | Hersteller / Anbieter | Produkthaftungsgesetz (ProdHaftG) |

| Fehlende Patienteninformation | Betreiber / Pflegeeinrichtung | EU AI Act (Art. 26 / Art. 86) |

| Wesentliche Systemänderung | Partei, die die Änderung vornimmt | Produkthaftungsrichtlinie (Art. 10) |

Verstöße gegen den EU AI Act können zu hohen Strafen führen: bis zu 7 % des weltweiten Jahresumsatzes oder 35 Millionen €, je nachdem, welcher Betrag höher ist. Diese Bußgelder liegen weit über den maximalen Strafen der DSGVO.

Eine gründliche Dokumentation ist entscheidend, um Haftungsrisiken zu minimieren. Dazu gehört die lückenlose Erfassung aller Software-Updates und Systemänderungen. Dies entspricht den Anforderungen der Produkthaftungsrichtlinie[16]. Insbesondere bei Hochrisiko-KI-Systemen, wie sie in Art. 6 des EU AI Act definiert sind, ist eine kontinuierlich aktualisierte technische Dokumentation sowie ein automatisches Logging vorgeschrieben[2].

Ein bewährtes Mittel, um die Qualität von KI-Systemen zu überprüfen, sind sogenannte Test Cases. Diese bestehen aus tatsächlichen Eingaben und den gewünschten Ausgaben. Sie helfen, Schwächen wie fehlerhafte Datenverarbeitung oder sogenannte „Halluzinationen“ zu erkennen. Gleichzeitig wird sichergestellt, dass personenbezogene Daten korrekt bleiben, wie es die DSGVO fordert[6].

„Test Cases sind ein hervorragendes Mittel zur Dokumentation der Qualität von KI-Systemen. Sie können solche Systeme auch transparenter machen und ihre verbleibenden Schwächen aufzeigen."

– Klaus Meffert, Dr. der Informatik und IT-/Datenschutzexperte[6]

Ein weiterer wichtiger Baustein ist die Schulung der Mitarbeitenden. Sie müssen die rechtlichen Rahmenbedingungen kennen und in der Lage sein, KI-generierte Inhalte kritisch zu bewerten. Das Prinzip „Human-in-the-Loop“, bei dem qualifiziertes Personal die Ergebnisse der KI überprüft und freigibt, reduziert das Risiko von schwer nachvollziehbaren Fehlern[4][17]. Diese Maßnahmen unterstreichen, wie wichtig gut dokumentierte und nachvollziehbare KI-Anwendungen in der Pflege sind.

Neben Haftungsfragen spielt die Transparenz und Erklärbarkeit von KI-Entscheidungen eine zentrale Rolle, insbesondere im Gesundheits- und Pflegebereich.

In der Pflegedokumentation bedeutet Transparenz, dass klar erkennbar ist, wann und wie KI eingesetzt wird. Pflegekräfte müssen in der Lage sein, die Ergebnisse der KI nachzuvollziehen und fachlich einzuordnen. Das ist nicht nur eine Vertrauensfrage, sondern auch eine rechtliche Anforderung. Laut Artikel 86 des EU AI Act haben Bewohnerinnen und Bewohner das Recht auf eine Erklärung, wenn Hochrisiko-KI-Systeme Entscheidungen beeinflussen, die ihre Pflege oder Gesundheit betreffen[2].

Pflegeeinrichtungen sind verpflichtet, betroffene Personen zu informieren, sobald KI-Systeme zur Unterstützung von Entscheidungen eingesetzt werden – sei es bei der KI-gestützten Pflegeplanung oder bei der Bewertung des Gesundheitszustands[2]. Besonders bei direktem Kontakt, etwa mit Pflegerobotern oder Chatbots, muss klar erkennbar sein, dass es sich um eine Interaktion mit einer KI handelt[2][18]. Verstöße gegen diese Transparenzanforderungen können erhebliche Strafen nach sich ziehen.

„KI-Systeme sind jetzt leicht zugänglich und ermöglichen die Erstellung täuschend echter, synthetischer Inhalte. Daher gibt es einen wachsenden Ruf nach mehr Transparenz: Es wird gefordert, Einblicke in die Funktionsweise von KI-Systemen zu erhalten und die Nutzung von KI klar zu kommunizieren, zu kennzeichnen und nachvollziehbar zu machen."

– Marlene Schreiber, Partnerin und Fachanwältin für IT-Recht[2]

Transparenz hat zwei Dimensionen: externe Transparenz für Bewohnerinnen und Bewohner sowie interne Transparenz für die Pflegeeinrichtungen. Externe Transparenz sorgt dafür, dass Betroffene informiert sind, während interne Transparenz Pflegekräften ermöglicht, die Funktionsweise der KI zu verstehen und potenzielle Fehler zu erkennen. Eine automatische Protokollierung (Logging) aller Vorgänge von Hochrisiko-KI-Systemen ist vorgeschrieben, um Entscheidungen nachvollziehbar zu machen[2][4]. Zudem müssen KI-generierte Inhalte, wie beispielsweise Texte in Dokumentationen, klar als solche gekennzeichnet werden – idealerweise in einem maschinenlesbaren Format[2][18].

Die Fristen für diese Anforderungen sind klar geregelt: Ab dem 2. August 2026 gelten sie für die meisten KI-Systeme, während Transparenzpflichten für allgemeine KI-Modelle bereits ab dem 2. August 2025 greifen[2][4]. Um Risiken frühzeitig zu erkennen und die interne Transparenz zu stärken, sollten Pflegeeinrichtungen Test Cases einsetzen[6].

Um den rechtlichen Vorgaben in der Pflegedokumentation zu entsprechen, muss die Einbindung von KI-Tools in die SIS-basierte Pflegeplanung sehr sorgfältig erfolgen. Die Strukturierte Informationssammlung (SIS) ist das zentrale Element der Pflegedokumentation in Deutschland. KI-Tools müssen sich nahtlos in die vier Kernphasen der SIS einfügen: Strukturierte Informationssammlung, Maßnahmenplanung, Pflegebericht und Evaluation[21]. Diese Anforderungen stehen in direktem Zusammenhang mit Datenschutz- und Haftungsfragen, die bereits thematisiert wurden.

Besonders entscheidend ist die Risikoeinschätzung in Feld C2, die eine Verknüpfung zwischen den fünf anerkannten Risikobereichen (Dekubitus, Sturz, Schmerz, Inkontinenz und Ernährung) und den narrativen Informationen aus Feld C1 erfordert[21]. Ohne diese Verknüpfung drohen Beanstandungen bei MD-Prüfungen. Neben der Risikoeinschätzung spielt auch die Strategie der Dokumentation eine wichtige Rolle für die Rechtssicherheit in der Pflegeplanung.

Ein weiterer rechtlicher Punkt ist der „Immer-so-Beweis": Bei routinemäßiger Grundpflege ist eine abweichungsorientierte Dokumentation zulässig, wenn Standardverfahren im Qualitätshandbuch hinterlegt sind[21]. KI-Tools müssen diese Form der „Negativdokumentation" unterstützen. Für die Behandlungspflege bleibt jedoch der individuelle Nachweis jeder Maßnahme verpflichtend[21].

Für die rechtssichere Nutzung von KI in der SIS-Dokumentation ist qualifizierte Aufsicht unerlässlich. Die initiale SIS-Einschätzung muss von einer Pflegefachkraft durchgeführt oder überprüft werden, wie es das „Human-in-the-Loop"-Prinzip des EU AI Act vorsieht[21][2][1].

Ein Beispiel ist dexter health, ein intelligenter SIS-Assistent, der Pflegekräfte bei der strukturierten Erfassung von Anamnese, Risikoeinschätzung und Maßnahmenplanung unterstützt. Mithilfe von sprachgesteuerter Pflegedokumentation können Informationen direkt nach dem Bewohnerkontakt erfasst werden, während das System automatisch die Zuordnung zu den SIS-Feldern übernimmt. Dabei erfüllt die Lösung alle Anforderungen an rechtssichere Dokumentationen: Zeitstempel, elektronische Signaturen und die Unveränderbarkeit von Einträgen gewährleisten die gerichtliche Verwertbarkeit[19][20]. Solche KI-gestützten Systeme sparen nicht nur Zeit, sondern können auch die Einhaltung rechtlicher Vorgaben verbessern. Diese Integration stärkt den Rahmen für den rechtssicheren Einsatz von KI, wie es in den vorherigen Abschnitten beschrieben wurde.

Ab 2026 treten neue Regelungen in Kraft, die den Umgang mit KI in der Pflegedokumentation erheblich beeinflussen werden. Diese Änderungen basieren auf bisherigen Compliance-Vorgaben und setzen neue Standards, insbesondere im Hinblick auf Sicherheit, Transparenz und Innovation.

Am 1. Januar 2026 wird das Pflegeunterstützungs- und -entlastungsgesetz (PUEG), auch als BEEP Act bekannt, wirksam. Es verpflichtet cloudbasierte IT-Dienste im Gesundheitswesen, die Sicherheitsstandards des Bundesamts für Sicherheit in der Informationstechnik (BSI C5) einzuhalten. Für IT-Systeme, die nach dem 30. Juni 2025 eingeführt werden, gilt eine Übergangsfrist von 18 Monaten, in der eine BSI C5 Type I-Attestierung ausreichend ist.

Pflegeeinrichtungen sollten dringend prüfen, ob ihre KI-Dokumentationsanbieter die erforderlichen Zertifizierungen besitzen. Ohne diese Konformität könnten Anbieter von Ausschreibungen ausgeschlossen werden, und bestehende Verträge könnten gefährdet sein [22].

Am 11. Februar 2026 verabschiedete das Bundeskabinett das KI-Marktüberwachungs- und Innovationsförderungsgesetz (AI-MIG), das den EU AI Act in nationales Recht umsetzt. Die Bundesnetzagentur wird dabei als zentrale Marktaufsicht für KI-Systeme fungieren. Bundesdigitalminister Dr. Karsten Wildberger erklärte dazu:

„Mit diesem Gesetz setzen wir europäische Vorgaben möglichst innovationsfreundlich um und schaffen eine schlanke KI-Aufsicht mit klarem Fokus auf die Bedürfnisse der Wirtschaft" [27].

Ab dem 2. August 2026 gelten zudem spezielle Anforderungen für Hochrisiko-KI-Systeme, zu denen auch einige KI-Tools für Pflegebeurteilungen zählen könnten [23].

Das Bundesgesundheitsministerium verfolgt mit der Strategie „GEMEINSAM DIGITAL 2026“ ambitionierte Pläne. Bis 2028 soll KI-gestützte Dokumentation in mehr als 70 % der Gesundheits- und Pflegeeinrichtungen Standard sein. Ab 2027 wird die Nutzung des Kommunikationsdienstes KIM in der Pflege verpflichtend, und bis 2030 sollen über 20 Millionen Versicherte aktiv die elektronische Patientenakte verwenden [25][26].

Um auf die kommenden Änderungen vorbereitet zu sein, sollten Pflegeeinrichtungen folgende Maßnahmen ergreifen:

Diese Neuerungen markieren einen wichtigen Schritt in Richtung einer stärker digitalisierten und regulierten Pflegewelt, die sowohl Sicherheit als auch Effizienz in den Vordergrund stellt.

Der Einsatz von KI in der Pflegedokumentation unterliegt strengen rechtlichen Vorgaben, insbesondere der DSGVO und dem EU AI Act. Systeme, die als Hochrisiko-KI eingestuft werden – wie viele Anwendungen im Gesundheitswesen – müssen eine Konformitätsbewertung durchlaufen und mit einer CE-Kennzeichnung versehen sein [1][20]. Diese Regelungen stehen in direktem Zusammenhang mit Transparenz- und Haftungsfragen und bilden die Grundlage für den sicheren Einsatz von KI in der Pflege.

Transparenz und Nachvollziehbarkeit sind dabei gesetzlich vorgeschrieben. Artikel 13 des AI Act verlangt, dass Hochrisiko-Systeme so gestaltet sind, dass Betreiber die Ergebnisse sinnvoll interpretieren können. Zusätzlich müssen automatische Logging-Systeme (Art. 12) und technische Dokumentationen (Art. 11) geführt werden, um Entscheidungen von KI-Systemen rückverfolgbar zu machen [1][2]. IT- und Datenschutzexperte Klaus Meffert hebt hervor:

„Testfälle sind ein hervorragendes Mittel, um die Qualität von KI-Systemen zu dokumentieren. Sie können solche Systeme auch transparenter machen und ihre verbleibenden Schwächen aufzeigen" [6].

Die Verantwortung für den sicheren Betrieb von KI liegt sowohl bei den Anbietern als auch bei den Betreibern. Pflegeeinrichtungen sind verpflichtet, die Systeme gemäß den Anweisungen der Anbieter zu nutzen und potenzielle Risiken im Betrieb zu überwachen [1][2]. Gleichzeitig müssen Pflegekräfte über ausreichende Kenntnisse im Umgang mit KI verfügen, um Ergebnisse kritisch bewerten und mögliche Fehler erkennen zu können [1][6]. Diese geteilte Verantwortung ist entscheidend, um den steigenden Anforderungen an KI-Systeme gerecht zu werden.

Zusätzlich müssen Pflegeeinrichtungen Datenschutz-Folgenabschätzungen durchführen, das Personal schulen und die Systeme regelmäßig überprüfen. Wer diese Maßnahmen frühzeitig umsetzt, legt den Grundstein für eine rechtssichere und MDK-konforme Pflegedokumentation.

Gemäß Artikel 6 des EU AI Act fallen KI-Systeme, die in sensiblen Bereichen wie der Gesundheits- und Pflegedokumentation eingesetzt werden, unter die Kategorie „Hochrisiko“. Der Grund dafür ist, dass in diesen Bereichen besonders hohe Anforderungen an Sicherheit und Zuverlässigkeit gestellt werden. Schließlich geht es hier um den Schutz von Gesundheit und Leben, was eine präzise und verantwortungsvolle Anwendung solcher Technologien erfordert.

Für eine DSGVO-konforme, KI-gestützte Dokumentation gibt es einige wichtige Schritte, die berücksichtigt werden sollten:

Durch diese Maßnahmen wird sichergestellt, dass KI-gestützte Prozesse nicht nur effizient, sondern auch gesetzeskonform gestaltet sind.

Ab dem Jahr 2025/2026 wird es für Cloud-Dienste im deutschen Gesundheitswesen verpflichtend, eine aktuelle C5-Zertifizierung des Bundesamts für Sicherheit in der Informationstechnik (BSI) vorzuweisen. Diese Zertifizierung dient als Nachweis für die Einhaltung strenger Sicherheitsstandards.

Zusätzlich müssen Anbieter sicherstellen, dass sie die technischen und organisatorischen Maßnahmen gemäß § 393 SGB V einhalten. Diese Maßnahmen zielen darauf ab, Datenschutz sowie Datensicherheit bei der Nutzung von Cloud-Hosting-Lösungen zu gewährleisten und sensible Gesundheitsdaten vor unbefugtem Zugriff zu schützen.

Mit diesen Vorgaben soll das Vertrauen in Cloud-Technologien im Gesundheitsbereich gestärkt und ein hohes Schutzniveau sichergestellt werden.