KI-Tools wie ChatGPT erzeugen oft generische, datenschutzbedenkliche Berichte und erfüllen nicht die MDK‑Anforderungen.

Kurz gesagt: MDK-Prüfer können KI-generierte Berichte oft erkennen. Warum? KI-Tools wie ChatGPT erfüllen nicht die gesetzlichen Anforderungen an individuelle und personenzentrierte Pflegedokumentation (§ 70 SGB XI). Schwächen wie generische Formulierungen, fehlende Details und mögliche Datenschutzprobleme machen sie anfällig. Zudem verbietet die DSGVO automatisierte Entscheidungen im Pflegebereich.

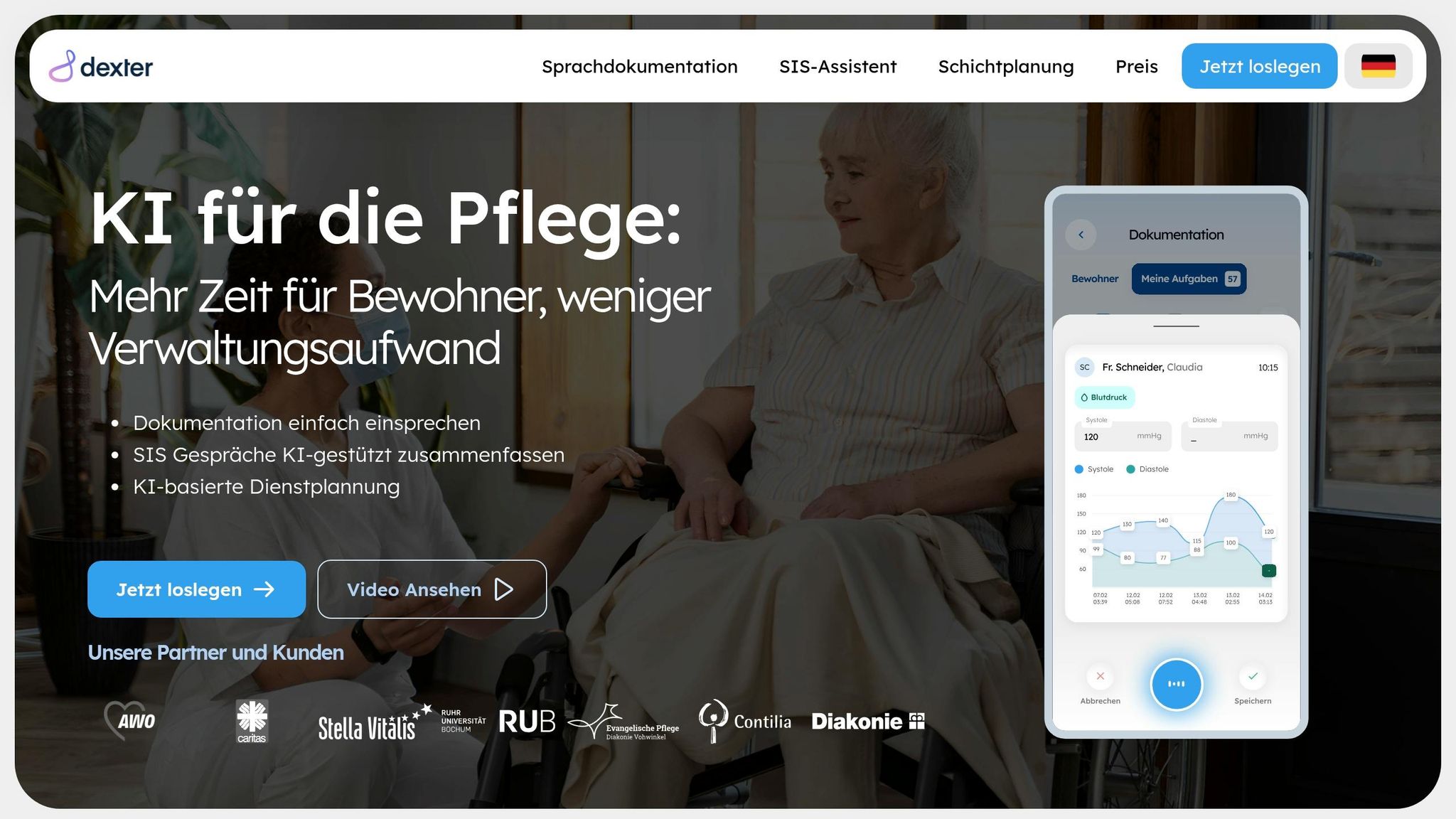

Lösung: KI sollte Pflegekräfte unterstützen, nicht ersetzen. Systeme wie dexter health kombinieren KI mit manueller Kontrolle, um MDK-konforme Berichte zu gewährleisten.

ChatGPT erfüllt die spezifischen Anforderungen der deutschen Pflegedokumentation nicht – insbesondere in rechtlicher und inhaltlicher Hinsicht. Diese Mängel können bei MDK-Prüfungen schnell auffallen. Im Folgenden wird erläutert, warum ChatGPT den Anforderungen des § 70 SGB XI nicht genügt.

Laut § 70 SGB XI muss eine Pflegedokumentation individuell und personenzentriert sein. ChatGPT, das auf statistischen Wahrscheinlichkeiten basiert, generiert jedoch häufig fiktive Details (sogenannte Halluzinationen). Dadurch wird die Verpflichtung zu einer individuellen Dokumentation verletzt. Anna Milena von Gersdorff, Leiterin Marketing bei GWriters, fasst dies treffend zusammen:

„Das Ziel der KI ist die Minimierung von Vorhersagefehlern, nicht die Reproduktion der Wahrheit" [4].

Ein weiteres großes Problem ist der Datenschutz: ChatGPT verarbeitet Daten auf Servern außerhalb der EU. Werden sensible Informationen wie Bewohnernamen, Gesundheitszustände oder Medikationsänderungen auf diesen Servern verarbeitet, kann dies gegen die DSGVO verstoßen [5]. Lars Werner, externer Datenschutzbeauftragter für Pflegeeinrichtungen, warnt:

„Gesundheitsdaten verlassen unter Umständen die geschützte Umgebung der Einrichtung, ohne dass dies bewusst wahrgenommen wird" [5].

Selbst anonymisierte Daten sind nicht automatisch sicher, da durch die Kombination von Alter, Krankheitsbild und anderen Merkmalen Rückschlüsse auf Einzelpersonen möglich sind.

ChatGPT erzeugt oft generische und standardisierte Formulierungen, die den individuellen Bedürfnissen eines Bewohners nicht gerecht werden. Statt präziser und spezifischer Beschreibungen nutzt die KI häufig vage Begriffe wie „häufig" oder „üblicherweise". Das widerspricht den Anforderungen an eine personenzentrierte Dokumentation [4]. Zudem wirkt der Textaufbau oft zusammenhangslos, da Absätze isoliert aneinandergereiht werden.

In akademischen Tests wurde festgestellt, dass KI-generierte Arbeiten oft durchfallen. Gründe dafür sind das Fehlen essenzieller Fachterminologie und falsche Quellenangaben [6].

Die genannten Schwächen machen es MDK-Prüfern leichter, potenzielle Unstimmigkeiten zu erkennen. Besonders problematisch sind erfundene Quellen – Verweise auf Studien oder Leitlinien, die es gar nicht gibt. Auch physikalisch unmögliche Angaben, wie falsche Seitenzahlen, fallen auf [4].

Ein weiteres Indiz ist die übermäßige Regelmäßigkeit der Texte. Während menschliche Dokumentationen oft variabler und individueller gestaltet sind, weisen KI-Texte eine auffallend einheitliche Struktur auf. Wenn zudem unklar ist, wie ein Bericht entstanden ist, wird die Prüfung kritisch. Anna Milena von Gersdorff betont:

„Eine durchmenschliche Überprüfung untersucht, ob Sie als Person die Kontrolle über den Entstehungsprozess nachweisen können und nicht, ob eine KI beteiligt war" [4].

MDK-Prüfer verfügen bislang über keine standardisierten Schulungen zur Erkennung von KI-generierten Texten. Dennoch können sie durch sprachliche Muster Hinweise darauf erhalten, ob ein Bericht von einer KI erstellt wurde. Kommerzielle KI-Scanner analysieren Texte Satz für Satz. Dabei deutet ein Wert von 25 auf Inhalte hin, die menschenähnlich formuliert sind, während ein Wert von 75 auf typische KI-Merkmale schließen lässt [7]. Diese Einschätzungen basieren vor allem auf wiederkehrenden Sprachmustern, die im Folgenden näher beschrieben werden.

Ein auffälliges Merkmal von KI-generierten Texten, wie denen von ChatGPT, sind standardisierte und formale Formulierungen. Diese greifen oft zu kurz, wenn es darum geht, den individuellen Pflegebedarf detailliert darzustellen. Allgemein gehaltene Aussagen wie „der Bewohner zeigt üblicherweise gute Fortschritte“ oder „die Pflege erfolgt regelmäßig nach Plan“ bieten kaum spezifische Informationen. Erfahrene Prüfer erkennen solche ungenauen Formulierungen schnell, da sie nicht die tatsächliche, individuelle Pflegesituation widerspiegeln. KI-Scanner, die numerische Bewertungen vornehmen, unterstützen die Prüfer zusätzlich bei der Einschätzung der Textquelle.

Obwohl es derzeit keine umfassenden Schulungsprogramme zur Erkennung von KI-generierten Inhalten gibt, steigen die regulatorischen Anforderungen in diesem Bereich. MDK-Prüfer betonen die Notwendigkeit einer zuverlässigen menschlichen Kontrolle, insbesondere im Hinblick auf die EU-Regularien wie die MDR 2017/745 und den EU AI Act 2024/1689 [3]. Susanne Moser bringt die Herausforderung auf den Punkt:

„Es ist ein langer, steiniger Weg, bis ChatGPT am Krankenbett über die Schulter schauen darf" [3].

Die Zertifizierung von KI-Systemen gestaltet sich besonders schwierig, da diese Systeme kontinuierlich lernen und sich anpassen können – im Gegensatz zu statischen Medizinprodukten wie Herzschrittmachern [3]. Diese Dynamik stellt eine zusätzliche Hürde dar, die es zu überwinden gilt.

Erkennungsrisiken von KI-generierten Pflegeberichten bei MDK-Prüfungen

Die Verwendung von KI-generierten Berichten birgt erhebliche Risiken im Kontext der MDK-Prüfungen. Werden solche Berichte von den Prüfern erkannt, kann dies zu schwerwiegenden Konsequenzen führen – von schlechteren Qualitätsbewertungen bis hin zu finanziellen und rechtlichen Problemen.

Eine der größten Herausforderungen ist die Tendenz von KI-generierten Texten, generisch und unvollständig zu sein. MDK-Prüfungen verlangen nach § 70 SGB XI jedoch individualisierte und detaillierte Berichte. Standardisierte Formulierungen, wie sie häufig in KI-Texten vorkommen, lassen auf eine unzureichende Beobachtung der Pflegesituation schließen und widersprechen dem Anspruch auf eine hochwertige, individuelle Pflege [10][11]. Solche Mängel führen nicht nur zu Punktabzügen, sondern können auch die öffentliche Bewertung der Einrichtung beeinträchtigen. Diese Bewertungen sind für potenzielle Bewohner und deren Angehörige ein entscheidender Faktor bei der Wahl einer Pflegeeinrichtung.

Die wirtschaftlichen und rechtlichen Risiken sind ebenfalls nicht zu unterschätzen. Lückenhafte Dokumentationen können Retaxationen zur Folge haben, bei denen bereits gezahlte Leistungen zurückgefordert werden [9]. Laut Schätzungen verlieren deutsche Krankenhäuser jährlich etwa 2,2 Milliarden Euro durch MDK-Prüfungen, und einzelne Einrichtungen können bis zu 5 % ihres Jahresbudgets einbüßen [8].

Hinzu kommt, dass Pflegedokumentationen als Urkunden gelten. Wenn KI-generierte Berichte von der tatsächlichen Pflege abweichen, könnten sie als Urkundenfälschung eingestuft werden [11]. In Rechtsstreitigkeiten wird die Beweislast dann oft auf die Einrichtung verlagert, wenn die Dokumentation als unzuverlässig eingestuft wird. Zudem verstoßen nicht zertifizierte KI-Tools wie Standard-ChatGPT gegen den EU AI Act und die Medizinprodukteverordnung (MDR) [3], was weitere rechtliche Probleme nach sich ziehen kann.

| Warnsignal | Beispiel in KI-Ausgabe | MDK-Reaktion | Risikolevel |

|---|---|---|---|

| Halluzinationen | Dokumentation einer nie verabreichten Behandlung oder Medikation | Sofortige Ablehnung; Betrugsverdacht | Kritisch |

| Generische Formulierungen | „Der Bewohner wurde nach Standards versorgt" – ohne spezifische Details | Punktabzug wegen fehlender Personalisierung (§ 70 SGB XI) | Hoch |

| Widersprüche | KI-Text widerspricht Vitalwerten oder Medikationsliste in derselben Akte | Zweifel an der Glaubwürdigkeit der gesamten Dokumentation | Hoch |

| Fehlende Nachvollziehbarkeit | Pflegeentscheidungen ohne dokumentierte, evidenzbasierte Begründung | Haftungsrisiken und Verstoß gegen den EU AI Act | Mittel |

Die Risiken generischer KI-Dokumentationen sind nicht zu unterschätzen. Genau hier setzt dexter health an und zeigt, wie MDK-konforme Berichte möglich werden. Während herkömmliche KI-Tools oft Schwächen in der Einhaltung der strengen Anforderungen der deutschen Pflegedokumentation zeigen, kombiniert dexter health gezielte KI-Unterstützung mit diesen Vorgaben. Das Ergebnis: minimierte Erkennungsrisiken, die bei Standard-LLMs häufig auftreten. Im Folgenden werden die zentralen Funktionen vorgestellt, die die MDK-Konformität sichern.

Die Sprachdokumentation bildet das Herzstück von dexter health. Pflegekräfte können direkt nach dem Kontakt mit Bewohnern per Spracheingabe dokumentieren. Dabei wird natürliche Sprache erfasst, wodurch typische KI-Merkmale wie ungewöhnliche „Frequenzverhältnisse“ oder „Silbenverteilungen“ vermieden werden [1]. Ergänzt wird dies durch den intelligenten SIS-Assistenten, der die Dokumentation nach dem bewährten Modell der Strukturierten Informationssammlung (SIS) organisiert. Dabei hält er sich strikt an die Vorgaben des § 70 SGB XI und vermeidet die „AI-typischen“ Marker, die in Standard-GPT-Ausgaben häufig auffallen [7].

Zusätzlich sorgt die Integration mit bestehenden deutschen Pflegedokumentationssystemen dafür, dass die KI-unterstützten Einträge nahtlos in die bisherigen Bewohnerdaten passen. Das ist besonders wichtig, da Widersprüche in den Daten oft manuelle Überprüfungen durch MDK-Inspektoren nach sich ziehen [2].

Dank dieser durchdachten Funktionen wird der Dokumentationsaufwand erheblich reduziert, ohne die Qualität zu beeinträchtigen. Manuelles Tippen und doppelte Eintragungen entfallen, wodurch Pflegekräfte mehr Zeit für die direkte Betreuung der Bewohner gewinnen. Gleichzeitig bleibt die Dokumentation auf einem hohen Niveau. Für MDK-Prüfungen bietet die Lösung strukturierte und personalisierte Pflegeberichte, die optimal vorbereitet sind. Das schützt Einrichtungen vor negativen Bewertungen durch den MDK.

dexter health bietet flexible Preismodelle, die sich an der Größe der jeweiligen Einrichtung orientieren – zum Beispiel an der Anzahl der Bewohner oder Pflegekräfte. Jedes Angebot umfasst eine persönliche Beratung, ein umfassendes Onboarding und kontinuierlichen Support. Dabei wird speziell auf die Bedürfnisse deutscher Pflegeheime eingegangen, und selbstverständlich werden höchste Datenschutzstandards gemäß EU-Richtlinien eingehalten.

Die Art und Weise, wie Pflegekräfte digitale Tools nutzen, beeinflusst maßgeblich die Effizienz und MDK-Sicherheit der Dokumentation. Drei bewährte Methoden helfen dabei, die Dokumentation sowohl effektiv als auch regelkonform zu gestalten.

Die Qualität der Ergebnisse einer KI hängt stark von präzisen Eingaben ab. Eine bewährte Methode ist die 4-Schritte-Struktur: Geben Sie die Rolle (z. B. „Fachkraft für Altenpflege"), den Kontext (z. B. „Bewohner mit Demenz Stufe 2"), die Aufgabe (z. B. „Tagesbericht erstellen") sowie den gewünschten Stil und das Format (z. B. „professionell, maximal 200 Wörter, Stichpunkte") vor[12][13].

Ein wichtiger Hinweis: Vermeiden Sie die Verwendung von echten Namen oder sensiblen Daten in öffentlichen KI-Tools. Bei dexter health entfällt dieses Problem, da die Sprachdokumentation direkt im geschützten System erfolgt. Beobachtungen können direkt am Bett erfasst werden, wodurch automatisch individuelle Einträge entstehen – im Gegensatz zu generischen Textbausteinen[9]. Diese präzisen Eingaben bilden die Grundlage für eine hochwertige Dokumentation, die durch eine manuelle Prüfung zusätzlich abgesichert wird.

Alle KI-generierten Berichte sollten vor ihrer Freigabe überprüft werden. Ein Zitat des Beth Israel Deaconess Medical Center bringt es treffend auf den Punkt:

„AI is probably most useful when it supports the human thinking process, but does not replace it." [13]

Ein „Human-in-the-Loop"-Ansatz ist daher unverzichtbar. Pflegekräfte sollten jeden Bericht in einem „Prüfen und Bestätigen"-Schritt abgleichen, um sicherzustellen, dass die Struktur und Inhalte den tatsächlichen Zustand und die Bedürfnisse des Bewohners widerspiegeln. Automatisierte Plausibilitätschecks können dabei helfen, in Sekundenschnelle Widersprüche oder fehlende Pflichtfelder zu erkennen[9]. Darüber hinaus ist es essenziell, die Mitarbeiter regelmäßig zu schulen, um die Qualität der Dokumentation langfristig sicherzustellen.

Eine umfassende Schulung der Pflegekräfte ist der Schlüssel, um die beschriebenen Prozesse nachhaltig zu implementieren. Eine Pilotphase von 4 bis 8 Wochen auf einer einzelnen Station bietet die Möglichkeit, die Qualität der Prompts und die Dokumentationsstandards zu optimieren, bevor das System flächendeckend eingeführt wird[9].

In diesen Schulungen lernen Pflegekräfte, direkt am Bett zu dokumentieren – beispielsweise per Mobilgerät während oder unmittelbar nach der Pflege. Diese unmittelbare Erfassung führt zu detaillierteren und persönlicheren Einträgen und verhindert das generische Erscheinungsbild von Berichten, die mit Zeitverzug erstellt werden.

Der Zeitaufwand für die Dokumentation kann so von 45 auf 10 Minuten pro Schicht reduziert werden – eine Einsparung von 75 %. Bei 100 Pflegekräften ergibt sich daraus ein täglicher Gewinn von etwa 58 Stunden, die stattdessen für die direkte Betreuung der Bewohner genutzt werden können[9].

KI-Tools können die Pflegedokumentation deutlich beschleunigen, erfüllen jedoch allein nicht die Anforderungen des MDK. Der Kernpunkt ist klar: KI sollte als Unterstützung dienen, nicht als Ersatz für menschliches Fachwissen. Wie Calvin Cheung es treffend ausdrückt:

„AI can support, but it should not replace your thinking" [2].

Hinsichtlich Datenschutz in der Pflegedokumentation ist die Lage eindeutig. Gemäß Artikel 22 der DSGVO ist eine automatisierte Entscheidungsfindung verboten – Pflegekräfte müssen jeden Eintrag persönlich bestätigen [3]. MDK-Prüfer erkennen schnell generische Formulierungen und wiederholende Strukturen, die auf mangelnde Individualisierung hinweisen. Die Folgen unzureichender Dokumentation zeigen, wie wichtig praxisnahe und KI-gestützte Lösungen sind.

Hier setzt dexter health an: Mit Sprachdokumentation direkt am Bett können individuelle Beobachtungen in Echtzeit erfasst werden. Diese Verbindung aus KI-Unterstützung und manueller Überprüfung stellt sicher, dass die Pflegedokumentation sowohl effizient als auch individuell bleibt. Das Ergebnis: weniger Dokumentationsaufwand bei gleichbleibend hoher Qualität und Personalisierung.

Für eine erfolgreiche Umsetzung sind präzise Eingaben, eine konsequente manuelle Überprüfung und regelmäßige Mitarbeiterschulungen entscheidend. Eine Pilotphase ermöglicht es, Prozesse zu optimieren, bevor die Lösung flächendeckend eingeführt wird. So wird KI zu einem hilfreichen Werkzeug, das Pflegekräfte entlastet, ohne die Dokumentationsqualität oder MDK-Konformität zu gefährden.

Ein MDK-konformer Pflegebericht ist weit mehr als nur eine Auflistung von Tätigkeiten. Er muss vollständig und transparent die Pflegeleistungen, den Pflegezustand, durchgeführte Maßnahmen sowie den Verlauf der Pflege dokumentieren.

Warum ist das so wichtig? Nur durch eine lückenlose Aufzeichnung können die Anforderungen an Qualität und Nachvollziehbarkeit erfüllt werden. Das heißt, jede Maßnahme und jede Veränderung im Zustand der gepflegten Person sollte klar und verständlich festgehalten sein. So bleibt die Pflege nicht nur überprüfbar, sondern auch für alle Beteiligten – Pflegekräfte, Angehörige und den MDK – nachvollziehbar.

Ein gut geführter Pflegebericht ist also nicht nur Pflicht, sondern auch ein entscheidender Beitrag zur Sicherstellung einer hochwertigen Versorgung.

Um sicherzustellen, dass KI-gestützte Dokumentationen den Anforderungen der DSGVO entsprechen, sollten personenbezogene Daten entweder anonymisiert oder pseudonymisiert verarbeitet werden. Dies minimiert das Risiko, dass sensible Informationen unbefugt offengelegt werden.

Wenn Sie KI-Tools wie ChatGPT einsetzen, ist die Einwilligung der betroffenen Personen ein absolutes Muss. Ohne diese Zustimmung dürfen keine personenbezogenen Daten verarbeitet werden.

Ein weiterer wichtiger Punkt: Datenübertragungen sollten immer verschlüsselt erfolgen. Dies schützt die Informationen vor unbefugtem Zugriff während der Übertragung. Außerdem sollten Sie darauf achten, dass ausschließlich die notwendigen Daten verarbeitet werden – nicht mehr und nicht weniger.

Transparenz spielt eine zentrale Rolle. Betroffene müssen umfassend über ihre Rechte informiert werden, beispielsweise über ihr Recht auf Auskunft, Berichtigung oder Löschung ihrer Daten. Zusätzlich sollten klare Verträge und Vereinbarungen mit dem Anbieter des KI-Tools getroffen werden, um sicherzustellen, dass der Datenschutz auf allen Ebenen eingehalten wird.

Indem Sie diese Maßnahmen umsetzen, schaffen Sie eine solide Grundlage für den datenschutzkonformen Einsatz von KI in der Dokumentation.

Im Rahmen eines Audits ist es entscheidend, den Einsatz von KI klar und nachvollziehbar offenzulegen. Das bedeutet, dass KI-generierte Inhalte eindeutig gekennzeichnet werden müssen. Diese Transparenz ist notwendig, um sowohl rechtliche Anforderungen zu erfüllen als auch das Vertrauen der Nutzer zu stärken.