KI senkt Dokumentationsaufwand, doch Pflegekräfte müssen KI‑Vorschläge prüfen, Datenschutz wahren und rechtliche Vorgaben beachten.

KI in der Pflegeplanung kann den Dokumentationsaufwand drastisch senken – von 370 Stunden auf 7,4 Stunden pro Jahr. Doch trotz dieser Zeitersparnis bleibt die menschliche Kontrolle unverzichtbar. Pflegekräfte tragen weiterhin die Verantwortung, um individuelle Bedürfnisse zu berücksichtigen, ethische Standards einzuhalten und rechtliche Anforderungen wie den EU AI Act zu erfüllen.

Fazit: KI unterstützt Pflegekräfte, ersetzt sie aber nicht. Menschliche Kontrolle bleibt essenziell, um eine sichere, würdevolle und rechtssichere Pflege zu gewährleisten.

Automatisierte Pflegeempfehlungen können ohne menschliche Kontrolle erhebliche Probleme verursachen – selbst wenn sie auf den ersten Blick sinnvoll erscheinen. Ungeprüfte Vorschläge gefährden sowohl die Qualität der Pflege als auch die rechtliche Absicherung der Einrichtung. Das zeigt, warum eine fachliche Überprüfung unverzichtbar ist.

KI-Systeme treffen Entscheidungen oft auf Basis von Schlagworten, ohne den individuellen Kontext eines Bewohners zu berücksichtigen. Zwar können sprachbasierte Dokumentationshilfen den Aufwand um 20–30 % reduzieren, doch die Sicherstellung der Datenqualität erfordert weiterhin eine menschliche Validierung [3].

Ein weiteres Problem sind algorithmische Verzerrungen: KI-Modelle neigen dazu, aufgrund von Faktoren wie Alter, Geschlecht oder bestimmten Diagnosen unangemessene Empfehlungen zu geben [1][4]. Ohne menschliches Eingreifen bleiben solche Fehler unentdeckt. Darüber hinaus fehlt KI die Fähigkeit, entscheidende Aspekte wie Würde, Autonomie oder zwischenmenschliche Beziehungen angemessen zu berücksichtigen [3].

Wenn eine KI-Empfehlung dazu führt, dass ein Sturzrisiko übersehen oder eine klinische Verschlechterung wie Sepsis nicht erkannt wird [4], trägt letztlich die Pflegeeinrichtung die Verantwortung.

„Empfehlungen müssen nachvollziehbar sein – ‚Mensch entscheidet' ist kein Feigenblatt, sondern Governance-Pflicht." – MSI Partners [3]

Insbesondere sogenannte „Black-Box-Modelle“ machen es schwierig, die Grundlage von KI-Entscheidungen nachzuvollziehen. Das kann bei MDK-Prüfungen oder regulatorischen Inspektionen problematisch werden, vor allem wenn das System unter die Medizinprodukteverordnung (MDR) fällt. Neben Haftungsfragen ist auch der Schutz sensibler Daten ein kritischer Punkt.

Die Verarbeitung sensibler Bewohnerdaten unterliegt den strengen Vorgaben der DSGVO, deren Einhaltung durch Fachkräfte sichergestellt werden muss. Ohne menschliche Überprüfung drohen Verstöße, etwa durch unzureichende Einwilligungen oder mangelnde Transparenz gegenüber Bewohnern und Angehörigen [3]. Klare Zugriffsrechte und eine zuverlässige Verschlüsselung sind unverzichtbar – und nur Fachkräfte können deren konsequente Umsetzung gewährleisten [1][5].

Fehlende oder ungenaue Daten können zu fehlerhaften Prognosen führen, die den gesamten Pflegeplan beeinträchtigen [4]. Regelmäßige menschliche Validierungen sind daher entscheidend, um sicherzustellen, dass die KI auf vollständigen und korrekten Informationen basiert. Mit einem jährlichen Investitionswachstum von etwa 40 % in KI-Technologien für die Pflege [3] wird deutlich, dass Fortschritte nur dann sinnvoll sind, wenn sie mit starken Datenschutz- und Sicherheitsmaßnahmen kombiniert werden. Nur durch Echtzeit-Überprüfungen kann eine sichere und individuelle Pflegeplanung gewährleistet werden.

Die menschliche Kontrolle bei der Nutzung von KI in der Pflegeplanung ist nicht nur gesetzlich vorgeschrieben, sondern auch eine ethische Verpflichtung. Wer KI in diesem Bereich einsetzen möchte, muss die rechtlichen Rahmenbedingungen kennen und die Verantwortung für das Wohlergehen der Bewohner ernst nehmen. Diese Anforderungen sind entscheidend, um technische und menschliche Aspekte sinnvoll zu verbinden.

Laut dem EU AI Act werden KI-Anwendungen im Gesundheits- und Pflegebereich als Hochrisikotechnologien eingestuft [2]. Dies bedeutet, dass solche Systeme so konzipiert sein müssen, dass sie während ihrer Nutzung von Menschen überwacht werden können. Ziel ist es, Risiken für Gesundheit, Sicherheit und Grundrechte zu minimieren [6].

Artikel 14 des EU AI Act schreibt vor, dass Fachkräfte, die KI-Systeme überwachen, diese verstehen und in der Lage sein müssen, sogenannte Automation Bias – also die unreflektierte Übernahme von KI-Empfehlungen – zu erkennen und gegebenenfalls zu korrigieren [6]. Zusätzlich müssen die Systeme mit einer Stop-Funktion ausgestattet sein, um sie bei Bedarf sofort deaktivieren zu können [6].

In Deutschland gelten darüber hinaus die strengen Vorgaben der DSGVO, die beispielsweise eine verschlüsselte Datenspeicherung und transparente Einwilligungsprozesse vorschreiben [1]. Dabei bleibt klar: KI ist ein Hilfsmittel, aber niemals ein Ersatz für das professionelle Urteilsvermögen von Pflegekräften [1].

Neben den rechtlichen Vorgaben spielen auch ethische Überlegungen eine zentrale Rolle. Es ist von entscheidender Bedeutung, die Autonomie und Würde der Bewohner zu schützen. KI-Systeme sind nicht in der Lage, Empathie oder ein umfassendes Verständnis für die emotionalen, sozialen und individuellen Bedürfnisse eines Menschen zu entwickeln [7].

"AI should and must not replace human care, but should support care workers." – Prof. Dr. Karin Wolf-Ostermann, University of Bremen [2]

Das Vorsorgeprinzip erfordert, dass menschliches Eingreifen stets Vorrang hat, insbesondere wenn der Einsatz von KI potenziell negative Auswirkungen auf Menschenrechte oder die Sicherheit haben könnte [8]. Die endgültige Entscheidungsgewalt muss immer beim Menschen liegen. Nur so können komplexe und vielschichtige Pflegesituationen angemessen bewertet und bearbeitet werden.

Die Einführung menschlicher Kontrolle in KI-Systeme erfordert technische Lösungen, die sich problemlos in den Pflegealltag einfügen und das Prinzip „Human-in-the-Loop“ umsetzen. Dabei erstellt die Software Vorschläge, die von Pflegekräften geprüft, angepasst und erst nach manueller Freigabe in die Dokumentation übernommen werden. Diese Herangehensweise greift die zuvor besprochenen Anforderungen an rechtliche und ethische Verantwortung auf.

Moderne KI-gestützte Dokumentationssysteme bieten Pflegekräften die Möglichkeit, strukturierte Pflegepläne per Sprachbefehl zu erstellen. Doch diese Entwürfe sind keinesfalls endgültig – sie müssen stets überprüft und manuell freigegeben werden. Ein klar definierter „Prüfen und Freigeben“-Prozess stellt sicher, dass jede Empfehlung durch das Fachwissen der Pflegekräfte validiert wird.

Neben der erhöhten Effizienz, die solche Systeme bieten, gibt es auch einen messbaren Zeitgewinn: Studien zur Dokumentationsqualität zeigen, dass KI-gestützte Dokumentation den Arbeitsaufwand pro Pflegekraft täglich um 30 bis 45 Minuten senken und gleichzeitig die Fehlerquote reduzieren kann [1]. Dabei bleibt die gesetzlich vorgeschriebene Verantwortung vollständig bei den Pflegekräften.

Die Anbindung von KI-Tools an bestehende Pflegesoftware erfolgt über standardisierte Schnittstellen wie FHIR oder HL7 [4]. Dieser Ansatz ermöglicht eine schrittweise Integration der KI-Module, ohne dass bestehende Systeme ersetzt werden müssen. Pflegekräfte können Daten per Spracheingabe oder Text erfassen, die anschließend von der KI strukturiert und zur Prüfung bereitgestellt werden [1].

Ein stufenweises Vorgehen ist dabei entscheidend: Beginnen Sie mit einem Pilotprojekt auf einer Station, sammeln Sie Feedback der Mitarbeitenden und erweitern Sie den Einsatz schrittweise [4]. Schulungen sollten nicht nur die Bedienung des Systems abdecken, sondern auch erklären, wie die KI Vorschläge generiert und welche Grenzen sie hat. Dieses Wissen hilft Pflegekräften, algorithmische Fehler oder Verzerrungen rechtzeitig zu erkennen und zu korrigieren [1].

„Der wahre Durchbruch entsteht nicht durch komplexe Modelle, sondern durch Lösungen, die zuverlässig, erklärbar und sicher in bestehende Systeme eingebettet sind."

– Mikhail Dashuk, Engineering Manager, Vention [4]

Auf diese Weise wird die technische Umsetzung harmonisch in den Prozess der menschlichen Kontrolle integriert.

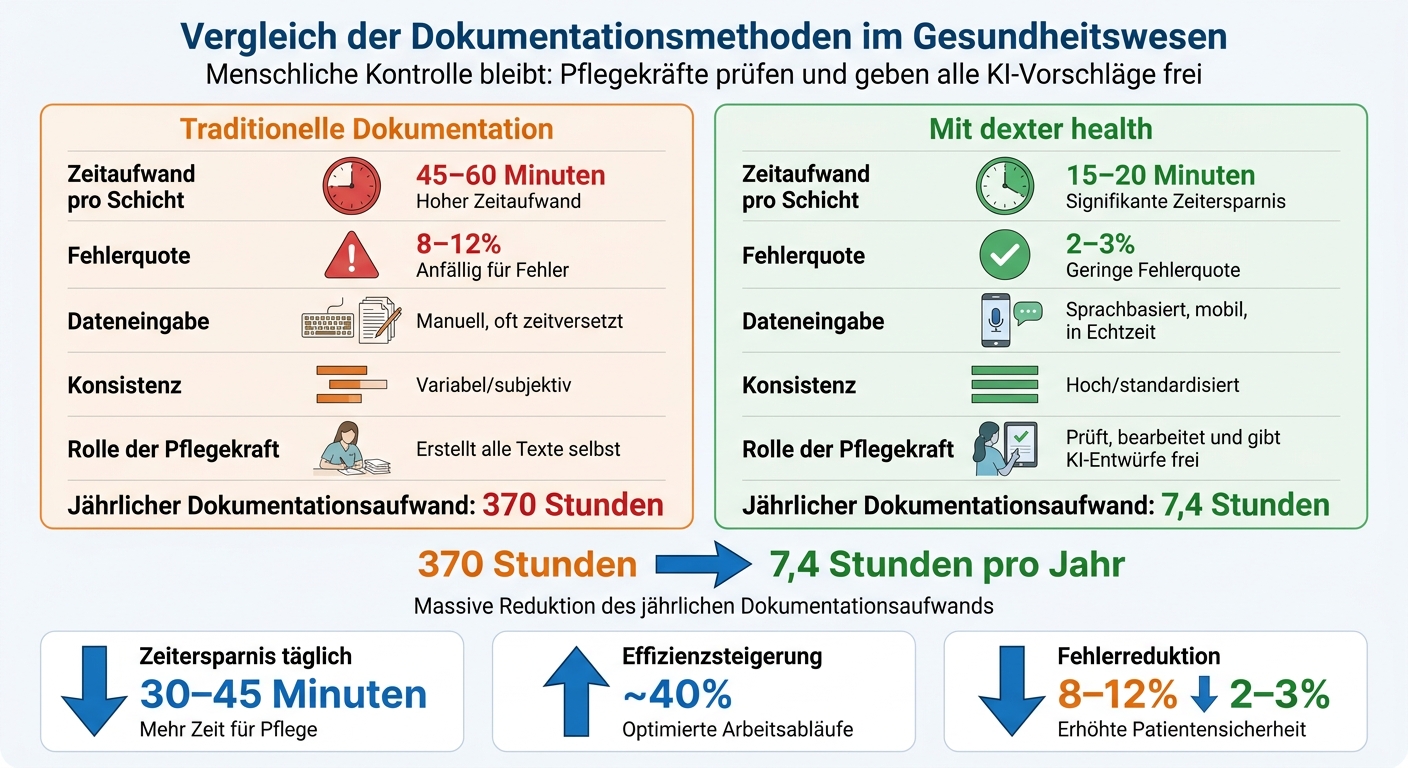

KI-gestützte vs. traditionelle Pflegedokumentation: Zeitersparnis und Fehlerreduktion im Vergleich

dexter health bringt menschliche Kontrolle und technologische Unterstützung in Einklang. Das System kombiniert Sprachdokumentation mit einem intelligenten SIS-Assistenten, der Pflegekräfte bei der strukturierten Dokumentation unterstützt, ohne dabei ihre Entscheidungsfreiheit einzuschränken. Hier ein Überblick über die zentralen Funktionen, die diesen Ansatz umsetzen.

Mit der Sprachdokumentation können Pflegekräfte direkt vor Ort relevante Stichworte wie „Demenz“, „Sturzrisiko“ oder „eingeschränkte Mobilität“ per Spracheingabe erfassen [1]. dexter health wandelt diese Eingaben in strukturierte Dokumentationseinträge um, die von den Pflegekräften geprüft, angepasst und freigegeben werden. Diese Überprüfungspflicht stellt sicher, dass die rechtliche Verantwortung weiterhin bei den Fachkräften bleibt.

Der SIS-Assistent verarbeitet die Eingaben nach dem Strukturmodell und erstellt Vorschläge für Anamnese, Risikoeinschätzung und Maßnahmenplanung. Pflegekräfte haben dabei jederzeit die Möglichkeit, jeden Textabschnitt anzupassen oder zu überschreiben, um die spezifischen Bedürfnisse der Bewohner korrekt widerzuspiegeln.

„Eine Pflegekraft gibt kurze Stichpunkte zur durchgeführten Maßnahme ein, und die KI erstellt daraus einen vollständigen, fachlich korrekten Dokumentationseintrag, der nur noch überprüft und bestätigt werden muss."

– basebox [5]

Darüber hinaus integriert sich dexter health nahtlos in bestehende Pflegesoftwaresysteme über sichere Schnittstellen. So bleiben Daten vollständig erhalten, und Pflegekräfte können weiterhin in ihrer gewohnten Umgebung arbeiten [1]. Die Spracherfassung spart dabei täglich 30–45 Minuten Dokumentationszeit und senkt die Fehlerquote von durchschnittlich 8–12 % auf 2–3 % [1].

Wie genau wirkt sich dexter health auf den Dokumentationsprozess aus? Ein Vergleich zeigt es:

| Aspekt | Traditionelle Dokumentation | Mit dexter health |

|---|---|---|

| Zeitaufwand pro Schicht | 45–60 Minuten | 15–20 Minuten |

| Fehlerquote | 8–12 % | 2–3 % |

| Dateneingabe | Manuell, oft zeitversetzt | Sprachbasiert, mobil, in Echtzeit |

| Konsistenz | Variabel/subjektiv | Hoch/standardisiert |

| Rolle der Pflegekraft | Erstellt alle Texte selbst | Prüft, bearbeitet und gibt KI-Entwürfe frei |

Dieser Vergleich verdeutlicht: Die KI übernimmt die Strukturierung und Organisation, während die Pflegekraft die fachliche Kontrolle und Verantwortung behält – ein Ansatz, der sowohl rechtlich als auch ethisch sinnvoll ist.

Eine rechtssichere und qualitativ hochwertige Pflegeplanung erfordert, dass der Mensch stets die Kontrolle behält. KI kann zwar Routineaufgaben wie das Strukturieren und Erstellen von Texten übernehmen, doch die fachliche Verantwortung liegt weiterhin bei den Pflegekräften. So bleiben Autonomie, Würde und gesetzliche Vorgaben, wie das Pflegeberufegesetz und die DSGVO, gewahrt.

Klare Vorteile auf einen Blick: Der tägliche Dokumentationsaufwand sinkt auf unter 45 Minuten, die Fehlerquote reduziert sich auf 2–3 % (statt 8–12 %), und die Effizienz steigt um etwa 40 % [1]. Dank standardisierter und konsistenter Dokumentation wird auch die Vorbereitung auf Prüfungen durch den Medizinischen Dienst deutlich einfacher. Diese Zahlen zeigen, wie wichtig die Verbindung von Technologie und menschlicher Expertise ist.

Mit dexter health wird dieser Ansatz umgesetzt: Sprachdokumentation, strukturierte Erstellung von SIS-Entwürfen und manuelle Freigaben ermöglichen es Pflegekräften, Zeit zu sparen, ohne die Qualität zu beeinträchtigen.

„KI ist ein Werkzeug zur Unterstützung der Pflegekräfte, nicht zu deren Ersatz. Die menschliche Zuwendung und Fürsorge bleiben das Herzstück guter Pflege."

– Lizzy Herzer, basebox [5]

Für den Einsatz von KI in der Pflegeplanung gilt das „Vier-Augen-Prinzip“ als essenziell: Jede Empfehlung der KI muss von einer Fachkraft geprüft und freigegeben werden. Nur so bleibt die Pflege empathisch, individuell und rechtssicher.

KI kann in der Pflege dabei helfen, zeitintensive Routineaufgaben wie die Dokumentation zu erleichtern. Sie kann beispielsweise Pflegeberichte erstellen, Textvorschläge liefern oder Unstimmigkeiten in Daten aufspüren. Wichtig bleibt jedoch, dass Pflegekräfte weiterhin die Kontrolle behalten, insbesondere bei Aufgaben, die menschliche Einschätzungen, ethische Überlegungen oder individuelle Entscheidungen erfordern. Dazu gehören etwa die Bewertung des Gesundheitszustands von Bewohnern oder die Planung von Maßnahmen. KI dient hier lediglich als unterstützendes Werkzeug und trifft keine abschließenden Entscheidungen.

Die Idee hinter „Human-in-the-Loop“ ist, dass KI-Systeme in bestehende Arbeitsabläufe eingebunden werden, ohne die menschliche Kontrolle zu ersetzen. Pflegekräfte können auf KI-Tools zurückgreifen, die automatische Vorschläge liefern. Diese Vorschläge müssen lediglich überprüft und bei Bedarf angepasst werden, was den Arbeitsaufwand nicht erhöht, aber die Effizienz steigert.

Ein weiterer Vorteil ist die Unterstützung durch Echtzeit-Dokumentation und Datenanalyse. Während die KI Daten sammelt und verarbeitet, behalten Pflegekräfte die Entscheidungsgewalt und treffen die finalen Entscheidungen. So entsteht eine Balance zwischen technischer Unterstützung und menschlichem Fachwissen.

Für den Einsatz von KI in der Pflegeplanung ist es unerlässlich, Nachweise zu erbringen, die die Anforderungen des EU AI Acts und der DSGVO erfüllen. Dazu zählen vor allem die sorgfältige Dokumentation von Risikobewertungen, die Implementierung von Transparenzmaßnahmen, die Einhaltung strenger Datenschutzvorkehrungen sowie die Umsetzung effektiver Sicherheitsmaßnahmen.