Leitfaden für KI in Pflegeheimen: Risikoidentifikation, Bewertung und Minderung mit EU‑Konformität, Datenschutz, Monitoring und Human‑in‑the‑Loop.

KI-Systeme in Pflegeheimen können den Alltag erleichtern, bergen aber auch Risiken. Rechtliche Vorgaben wie die EU-KI-Verordnung machen ein systematisches Risikomanagement unverzichtbar. Die Hauptgefahren? Datenschutzprobleme, algorithmische Verzerrungen, mangelnde Transparenz und ethische Konflikte. Lösungen? Frühzeitige Risikoanalyse, klare Compliance-Richtlinien, regelmäßiges Monitoring und der „Human-in-the-Loop“-Ansatz, bei dem Menschen die Kontrolle behalten.

Fazit: Nur durch umfassendes Risikomanagement können KI-Lösungen sicher, gesetzeskonform und effektiv in Pflegeheimen eingesetzt werden.

KI-Risikomanagement-Prozess für Pflegeheime: Von der Identifikation bis zum Monitoring

Die Herausforderungen von KI-Dokumentationssystemen in Pflegeheimen machen eine systematische Risikoidentifikation unverzichtbar. Nur so können Schwachstellen frühzeitig erkannt und effektive Gegenmaßnahmen ergriffen werden. Dieser Schritt ist entscheidend, bevor ein solches System in den Pflegealltag integriert wird.

KI-Systeme in Pflegeheimen verarbeiten äußerst sensible Gesundheitsdaten – von Bewegungsprofilen über Verhaltensmuster bis hin zu medizinischen Diagnosen. Diese Daten bergen erhebliche Risiken, da sie attraktive Ziele für Cyberangriffe darstellen. Durchschnittlich belaufen sich die Kosten einer Datenpanne auf 4,4 Millionen US-Dollar[4].

„Innovation ohne Aufsicht ist ein Risiko, das sich Unternehmen nicht leisten können." [4]

Nach der Erfassung der Risiken ist eine systematische Analyse unerlässlich.

Zusätzlich bieten AI Security Blueprints eine einheitliche Darstellung der Risiken über die gesamte Entwicklungspipeline hinweg[4]. Agentless Discovery-Tools erkennen Schwachstellen in Multi-Cloud-Umgebungen (AWS, Azure, GCP), ohne den Pflegebetrieb zu beeinträchtigen[4]. Für die Erkennung von algorithmischen Verzerrungen sollten Entwickler Fairness-Metriken wie die „Disparate Impact Ratio“ einsetzen[5].

Interdisziplinäre Teams, bestehend aus Datenwissenschaftlern, Pflegeexperten und Compliance-Beauftragten, sind entscheidend, um auch nicht-technische Risiken zu identifizieren[5]. Die ENSECUR GmbH bringt die Anforderungen treffend auf den Punkt:

„Nur wenn KI-Systeme transparent arbeiten, personenbezogene Daten geschützt bleiben und klare Regeln für den Umgang mit sensiblen Informationen gelten, kann KI in der Pflege eine echte Symbiose aus technologischer Innovation und Datenschutz schaffen." [3]

Nach der Identifikation von Risiken steht deren Bewertung und Minimierung im Fokus. Dieser Schritt ist entscheidend, um KI-Systeme sicher und im Einklang mit rechtlichen Vorgaben in Pflegeheimen einzusetzen. Die Grundlage für die Bewertung bildet die Formel: Risiko = Wahrscheinlichkeit × Schwere der Folgen[8]. Strukturierte Frameworks helfen dabei, Risiken präzise einzuschätzen und geeignete Gegenmaßnahmen zu entwickeln.

Die EU-KI-Verordnung (Artikel 9), die im Mai 2024 in Kraft trat, ist die erste umfassende Regelung dieser Art weltweit. Sie schreibt für Hochrisiko-Systeme ein kontinuierliches und iteratives Risikomanagement vor[8]. Artikel 9 betont:

„Das Risikomanagementsystem ist als kontinuierlicher iterativer Prozess zu verstehen, der während des gesamten Lebenszyklus eines Hochrisiko-KI-Systems geplant und durchgeführt wird und regelmäßige systematische Überprüfungen und Aktualisierungen erfordert." [1]

In Deutschland sind mehrere Frameworks für Pflegeheime relevant. ISO/IEC 42001:2023 ist der erste internationale Standard für KI-Managementsysteme (AIMS) und verlangt eine „AI System Impact Assessment". Diese ähnelt einer Datenschutz-Folgenabschätzung, fokussiert sich jedoch auf gesellschaftliche und individuelle Auswirkungen[9]. Ergänzend bleibt ISO/IEC 27001:2022 die Grundlage für die Informationssicherheit, um sensible Gesundheitsdaten zu schützen. Dr. Torge Schmidt von Datenschutz-notizen.de erklärt hierzu:

„Wenn bereits ein ISMS nach ISO/IEC 27001 betrieben wird, können die Methoden und Inhalte von ISO/IEC 42001 als Teil des ISMS integriert werden. Dies kann den zusätzlichen Aufwand für die Etablierung eines AIMS erheblich reduzieren." [9]

Das BSI AIC4 (Bundesamt für Sicherheit in der Informationstechnik) bietet spezifische Kriterien für KI-Cloud-Dienste in Deutschland[9]. Ergänzend unterstützt das NIST AI Risk Management Framework aus den USA mit vier zentralen Funktionen: Govern, Map, Measure und Manage[9][12].

| Framework | Schwerpunkt | Anwendung in Pflegeheimen |

|---|---|---|

| EU-KI-Verordnung (Art. 9) | Rechtliche Compliance | Verpflichtend für Hochrisiko-KI-Systeme zur Sicherung von Gesundheit und Grundrechten[1] |

| ISO/IEC 42001 | KI-Managementsystem | Grundlage für KI-Risikobewertung und Impact Assessments[9] |

| ISO/IEC 27001 | Informationssicherheit | Schutz sensibler Bewohnerdaten und Sicherstellung der Systemverfügbarkeit[9] |

| BSI AIC4 | Cloud-Sicherheit | Relevant für deutsche Anbieter, die KI-Cloud-Dienste nutzen[9] |

Diese Frameworks schaffen die Basis für konkrete Maßnahmen zur Risikominderung.

Die Minderung identifizierter Risiken folgt einer klaren Priorisierung: Zunächst werden Risiken durch Design und Entwicklung eliminiert oder reduziert. Für verbleibende Risiken kommen technische Kontrollmaßnahmen zum Einsatz, ergänzt durch Schulungen und klare Informationen für Pflegekräfte , um die Dokumentationsqualität in Pflegeeinrichtungen nachhaltig zu steigern[1].

Technische Schutzmaßnahmen wie Adversarial Training, das gezielte Angriffsmuster berücksichtigt, und Input-Validierung gegen „Prompt Injections" (Manipulationsversuche durch Nutzer) spielen eine zentrale Rolle[8]. Um „Data Decay" (Veralterung von Daten) zu verhindern, ist ein kontinuierliches Monitoring notwendig[8][12].

Fairness-Audits überprüfen regelmäßig die Trainingsdaten auf Verzerrungen, etwa in Bezug auf Alter, Geschlecht oder Herkunft. Ziel ist es, diskriminierende Ergebnisse bei Pflegebewertungen und MDK-Prüfungen zu vermeiden[6][7]. Jan Kahmen von turingpoint unterstreicht:

„Vertrauenswürdige KI basiert auf Verantwortlichkeit – und Verantwortlichkeit erfordert Transparenz." [7]

Die Integration von Management-Systemen kann den administrativen Aufwand erheblich reduzieren. Organisationen, die bereits ISO/IEC 27001 anwenden, können die spezifischen Anforderungen von ISO/IEC 42001 problemlos einbinden[9]. Eine Umfrage unter 1.250 IT-Führungskräften aus dem Jahr 2025 zeigt jedoch, dass klassische Governance-Modelle mit der Geschwindigkeit der KI-Entwicklung oft nicht mithalten können[11]. Daher ist eine enge Zusammenarbeit zwischen Datenwissenschaftlern, Pflegekräften und Compliance-Experten essenziell, um sowohl technische als auch organisatorische Risiken effektiv anzugehen[11].

Risikomanagement sollte in jeder Phase des KI-Lebenszyklus verankert sein – von der ersten Idee bis hin zum laufenden Betrieb. Die EU-KI-Verordnung fordert ausdrücklich einen fortlaufenden Ansatz, der mit Audit- und Änderungsmanagementprozessen verknüpft ist. Für Pflegeheime bedeutet das, Risikomanagement in ihre täglichen Abläufe zu integrieren, anstatt es als einmalige Compliance-Maßnahme zu betrachten. Im Folgenden wird erläutert, wie Risikomanagement in den jeweiligen Lebenszyklusphasen umgesetzt werden kann.

In der Design-Phase beginnt alles mit der systematischen Klassifizierung der KI-Anwendungsfälle. Hier werden mögliche technische, ethische und rechtliche Risiken identifiziert, bevor überhaupt mit der Entwicklung begonnen wird. Während der Entwicklungs- und Validierungsphase stehen Tests auf Verzerrungen und Fairness im Fokus, um sicherzustellen, dass Modelle keine diskriminierenden Tendenzen aufweisen. In der Deployment-Phase liegt der Schwerpunkt auf Sicherheitsmaßnahmen und der Einhaltung regulatorischer Anforderungen wie der DSGVO und der KI-Verordnung. Verstöße können teuer werden: Die DSGVO sieht Bußgelder von bis zu 20 Millionen Euro oder 4 % des weltweiten Jahresumsatzes vor[13]. Schließlich erfordert die Betriebsphase ein kontinuierliches Echtzeit-Monitoring, um Probleme wie „Model Drift“ (Leistungsverschlechterungen) oder Anomalien frühzeitig zu erkennen. Automatisierte Dashboards mit Echtzeit-Benachrichtigungen helfen dabei, unentdeckte Systemfehler zu identifizieren, bevor diese den Betrieb beeinträchtigen. Diese strukturierte Herangehensweise ermöglicht es, Risiken frühzeitig zu erkennen und effektiv zu managen.

Neben der technischen Umsetzung ist auch die organisatorische Dimension des Risikomanagements entscheidend. Eine klare Governance-Struktur ist der Ausgangspunkt. Dazu gehören ein KI-Ethikkomitee und spezialisierte Risk Officers, die Verantwortlichkeiten definieren. Quality Gates, also festgelegte Kontrollpunkte, sorgen dafür, dass keine Phase ohne Prüfung abgeschlossen wird. Risk Heatmaps helfen, Risiken nach ihrer Dringlichkeit zu priorisieren: rot für kritische Bereiche (z. B. Gesundheitsentscheidungen), gelb für moderate und grün für geringfügige Risiken. Diese Visualisierung ermöglicht eine gezielte Ressourcenverteilung.

Für jedes KI-Modell sollten Model Cards erstellt werden – detaillierte Dokumentationen, die Audit-Trails enthalten und die Nachvollziehbarkeit sicherstellen. Die Zahlen sprechen eine deutliche Sprache: Im Jahr 2023 überstiegen die weltweiten Bußgelder im Zusammenhang mit KI-Compliance 2 Milliarden US-Dollar, und Sicherheitsvorfälle im KI-Bereich stiegen um 74 %[13].

Ein weiterer wichtiger Punkt ist der Ansatz von Human-in-the-Loop (HITL). Besonders in der Pflege müssen menschliche Fachkräfte die Entscheidungsgewalt behalten. Automatisierte Systeme dürfen keine kritischen Entscheidungen ohne menschliche Aufsicht treffen. Ergänzt wird dies durch Explainable AI (XAI), die sicherstellt, dass Entscheidungen – etwa bei Gesundheitsbewertungen oder Pflegedokumentationen – für Prüfer und Nutzer verständlich bleiben.

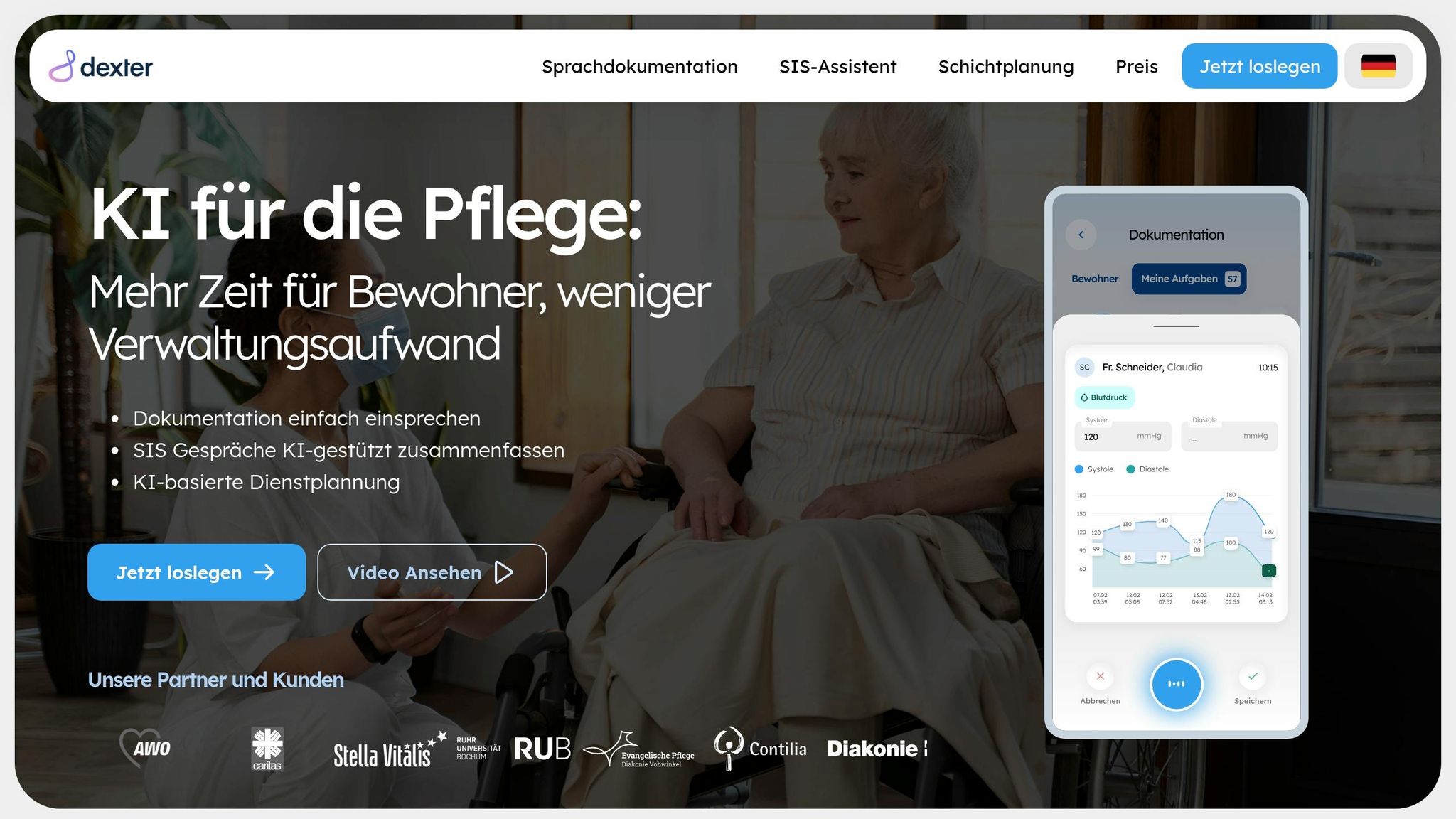

dexter health zeigt, wie Risikomanagement und Compliance von Anfang an in KI-Lösungen integriert werden können. Das Unternehmen setzt auf strenge Datenschutzstandards, die den Anforderungen der EU entsprechen. Die Sprachdokumentation und der intelligente SIS-Assistent lassen sich nahtlos in bestehende Pflegedokumentationssysteme einfügen, ohne Sicherheitslücken zu schaffen.

Marc Margulan, ein ehemaliger Arzt, der die Herausforderungen durch Personalmangel und Dokumentationsaufwand aus erster Hand kennt, und Eren Cirit, der als pflegender Angehöriger eigene Erfahrungen in der Altenpflege gesammelt hat, haben diese Perspektiven in die Entwicklung einfließen lassen. Das Ergebnis ist ein System, das nicht nur Zeit spart und die Dokumentationsqualität verbessert, sondern auch die Anforderungen des Medizinischen Dienstes erfüllt. Onboarding- und Schulungsprogramme sorgen dafür, dass Pflegekräfte die Software sicher nutzen können – ein zentraler Aspekt des HITL-Ansatzes. Zudem stellt die Lösung sicher, dass Audit-Trails und Transparenz gewährleistet sind, um Prüfungen durch Aufsichtsbehörden standzuhalten.

Sobald Risikomanagement-Frameworks implementiert sind, bleibt die Arbeit nicht stehen. KI-Systeme benötigen ständige Überwachung und Anpassung, um sicher, regelkonform und wirksam zu bleiben. Artikel 9 der EU-KI-Verordnung betont dies ausdrücklich: Risikomanagement ist ein fortlaufender Prozess[5]. Für Pflegeheime bedeutet das, dass KI-Systeme nach ihrer Einführung nicht einfach sich selbst überlassen werden dürfen. Stattdessen müssen sie kontinuierlich beobachtet, überprüft und bei Bedarf optimiert werden. Im Folgenden werden zentrale Methoden für Echtzeit-Monitoring und Auditing erläutert.

Ein effektives Monitoring beginnt mit automatisierten Dashboards, die die Leistung des Systems in Echtzeit überwachen. Dabei werden Fehlerquoten analysiert, Anomalien identifiziert und sämtliche KI-Entscheidungen systematisch protokolliert. Besonders wichtig ist die Überprüfung von Key Performance Indicators (KPIs). Beispiele hierfür sind:

„Risikomanagement ist kein einmaliges Projekt, sondern ein iterativer Zyklus." – Proliance[5]

Eine zentrale Compliance-Plattform kann den Aufwand für Audits erheblich reduzieren – in manchen Fällen um bis zu 70 %[5]. Ebenso hilfreich sind automatisierte Benachrichtigungen, die das Qualitätsmanagement-Team alarmieren, wenn vordefinierte Schwellenwerte, wie beispielsweise eine Fehlerquote von mehr als 10 %, überschritten werden. Besonders in der Pflege ist der sogenannte Human-in-the-Loop-Ansatz essenziell. Hierbei werden kritische Entscheidungen stets von Menschen überprüft, um algorithmische Fehler oder Verzerrungen zu vermeiden[5].

Nach der Einführung eines KI-Systems beginnt die Phase der Post-Market-Surveillance. Diese umfasst die systematische Überwachung während des laufenden Betriebs. Gemäß Artikel 72 der EU-KI-Verordnung sind Anbieter verpflichtet, Daten über die Leistung von Hochrisiko-KI-Systemen zu sammeln und auszuwerten, um deren Sicherheit langfristig zu gewährleisten[10]. Pflegeheime müssen dabei nicht nur die vorgesehene Nutzung, sondern auch mögliche Fehlanwendungen im Blick behalten[2].

Regelmäßige Risikoüberprüfungen – beispielsweise alle drei Monate – sind entscheidend, um Phänomene wie „Model Drift" frühzeitig zu erkennen[5]. Nach jedem größeren System-Update muss zudem eine neue Risikobewertung erfolgen. Für Pflegeheime, die als wesentliche oder wichtige Einrichtungen gelten, greifen darüber hinaus die NIS2-Meldepflichten für Cybersicherheitsvorfälle[5]. Ein gut strukturierter Incident-Response-Prozess, der alle Störungen gemäß Artikel 73 dokumentiert, ist ebenfalls unverzichtbar[10]. Feedback von Pflegekräften und Bewohnern sollte systematisch gesammelt und in die Weiterentwicklung des Systems integriert werden. So bleibt die KI-Lösung stets auf dem neuesten Stand und kann sich an veränderte Pflegestandards anpassen.

Aufbauend auf den zuvor beschriebenen Rahmenbedingungen des Risikomanagements werden hier typische Fehlerquellen und dazugehörige Lösungsansätze beleuchtet.

Bei der Einführung von Risikomanagement-Systemen können schwerwiegende Fehler auftreten, die nicht nur Compliance-Probleme, sondern auch Risiken für Bewohner nach sich ziehen können [14]. Experten haben zwölf häufige Fehler identifiziert, die Unternehmen im Zusammenhang mit KI und der EU-KI-Verordnung machen [14]. Die wichtigsten davon sowie mögliche Lösungen werden nachfolgend beschrieben.

Eine der Hauptursachen für Probleme ist die falsche Risikoklassifizierung von KI-Anwendungen. Dies führt oft zu unzureichender Dokumentation sowie zu mangelhaften Maßnahmen im Bereich Transparenz und Qualitätsmanagement [14]. Eine klare Lösung hierfür ist die Entwicklung einer Compliance-Roadmap, die durch Checklisten unterstützt wird, um Systeme korrekt einzuordnen.

Ein weiteres Problem ist das übermäßige Vertrauen in die Ergebnisse von KI-Systemen. Bei generativer KI können sogenannte „Halluzinationen“ auftreten – also Fehlinformationen, die auf den ersten Blick glaubwürdig wirken. In der Pflegedokumentation mit KI, wo Präzision absolut entscheidend ist, könnte dies schwerwiegende Folgen haben [14]. Marcus Greschner, Experte für Datenschutz und IT-Sicherheit, unterstreicht:

„Ein Human-in-the-Loop bleibt essenziell, um Halluzinationen zu reduzieren und Haftungsrisiken zu managen." [14]

Ein weiteres Risiko stellt die sogenannte „Shadow AI“ dar. Hierbei könnten Pflegekräfte versucht sein, nicht genehmigte KI-Tools für die Verarbeitung sensibler Patientendaten zu verwenden. Dies birgt die Gefahr von Datenlecks und Kontrollverlust [14]. Um dies zu vermeiden, sollten Unternehmen klare interne Richtlinien für den Einsatz von KI erstellen und sichere, autorisierte Alternativen anbieten. Dazu gehört auch eine „Whitelist“ zugelassener Tools sowie klare „Do/Don't“-Regeln, wie beispielsweise: Keine sensiblen Bewohnernamen in öffentliche KI-Dienste eingeben [14].

Schließlich führen schlechte Datenqualität und die nachträgliche Integration von Risikomanagement oft zu verzerrten Ergebnissen bei KI-Modellen [8][14]. Fehlende Kennzeichnung, veraltete oder mangelhafte Daten können dazu führen, dass KI-Systeme instabil werden und diskriminierende Ergebnisse liefern – ein besonderes Problem im Pflegebereich [8][14]. Die Lösung liegt in der Umsetzung strenger Data-Governance-Standards und der Nutzung von „Golden Records“ für kritische Pflegedaten, um sicherzustellen, dass die KI auf verlässlichen Daten basiert [14].

Die Entwicklung von KI-Systemen für Pflegeheime ist weit mehr als nur eine technische Herausforderung – sie erfordert ein solides Risikomanagement, das gesetzlich vorgeschrieben ist. Proliance bringt es auf den Punkt:

„Risikomanagement ist nicht mehr optional – es ist Pflicht" [5].

Zusammenarbeit ist der Schlüssel. IT-Expert:innen, Pflegekräfte, Compliance-Verantwortliche und das Management müssen gemeinsam technische, ethische und klinische Risiken angehen [16]. Der Human-in-the-Loop-Ansatz spielt dabei eine zentrale Rolle, insbesondere bei kritischen Anwendungen, um sicherzustellen, dass Pflegekräfte die Entscheidungsgewalt behalten [15].

Die Vorteile sind enorm: KI-gestützte Dokumentationssysteme können Pflegekräfte täglich um 30 bis 45 Minuten entlasten, die Fehlerquote von 8–12% auf 2–3% senken und die jährliche Dokumentationszeit von 370 Stunden auf nur 7,4 Stunden reduzieren – eine Zeitersparnis von 98% [17].

Risikomanagement sollte frühzeitig beginnen. Warten Sie nicht auf regulatorische Fristen – starten Sie jetzt mit der Implementierung des EDSA-Frameworks [5]. KI-Systeme können nicht nur den Zeitaufwand um bis zu 45 Minuten täglich reduzieren, sondern auch die Fehlerquote drastisch senken und den Audit-Aufwand um bis zu 70% verringern [5].

Ein weiterer zentraler Punkt: Transparenz und Erklärbarkeit sind essenziell. Ohne sie fehlt das Vertrauen in KI-Systeme. Tanja Bratan vom Fraunhofer ISI warnt:

„Die Nutzung KI-basierter CDSS darf nicht zum Verlust von Wissen, Fähigkeiten und Kompetenzen (De-Skilling) bei zukünftigen Nutzer:innen führen" [16].

Um dies zu verhindern, sollten Pflegekräfte im Bereich Data Literacy geschult werden. Zusätzlich sind direkte Feedback-Kanäle wichtig, um Fehler und sogenannte „Halluzinationen" schnell zu erkennen und zu beheben [16]. So wird die Integration von KI in der Altenpflege nicht nur sicher und effizient, sondern auch rechtskonform gestaltet.

Ein KI-System wird gemäß der EU-KI-Verordnung als Hochrisiko eingestuft, wenn es bestimmten Klassifizierungsregeln entspricht. In solchen Fällen ist eine sorgfältige Risikobewertung erforderlich, begleitet von einem umfassenden Risikomanagement, um die Anforderungen der Verordnung zu erfüllen.

Um „Human-in-the-Loop“ (HITL) in der Pflegedokumentation effektiv umzusetzen, müssen einige entscheidende Elemente beachtet werden. Dazu gehören klare Prüfpunkte, intuitive Benutzeroberflächen und messbare KPIs. Diese Komponenten stellen sicher, dass Pflegekräfte die KI-gestützten Vorschläge effizient prüfen und bei Bedarf korrigieren können, wodurch die Genauigkeit der Dokumentation verbessert wird.

Ein zentraler Aspekt ist die nahtlose Integration des Systems in den bestehenden Workflow. Das bedeutet, dass die Lösung so gestaltet sein muss, dass sie den Arbeitsalltag der Pflegekräfte erleichtert, anstatt ihn zu erschweren. Fehler sollten dabei leicht erkennbar und einfach zu beheben sein. Das Ziel ist es, die Arbeit der Pflegekräfte zu unterstützen, ohne zusätzlichen Stress oder unnötige Komplexität zu verursachen.

Einige der wichtigsten Anzeichen für potenzielle Probleme in KI-Systemen lassen sich durch gezielte Überwachung von KPIs identifizieren. Dazu gehören:

Diese Kennzahlen bieten eine solide Grundlage, um potenzielle Herausforderungen frühzeitig zu identifizieren und gezielt anzugehen.